近年来, 部分科技公司和研究人员先后开展了雷达手势目标识别探索工作。Google设计并开发了2款工作于60 GHz的专用毫米波雷达芯片, 并通过低维特征向量提取和随机森林分类器实现多种手势动作识别[15]。文献[16]利用光学、深度和雷达传感器数据融合, 通过异源图像配准及三维卷积神经网络(Convolutional Neural Network, CNN)进行典型驾驶手势动作识别。文献[17]利用77 GHz线性调频连续波(Linear Frequency Modulated Continuous Wave, LFMCW)雷达获取手势目标的微多普勒回波, 通过其能量在各速度单元的分布提取高斯累加模型参数作为特征向量, 进而结合隐马尔可夫模型实现手势动作识别。

目前, 典型的手势动作识别雷达系统主要工作于60 GHz或以上频段, 其具有较高的开发难度和成本要求; 此外, 三维卷积处理、异源图像匹配的引入也将提升算法复杂度。因此, 本文研究了一种适用于通用型24 GHz工业雷达传感器的手势动作识别方法。以24 GHz工业雷达作为传感器, 通过对手势目标的LFMCW雷达回波依次进行去斜、快时间域快速傅里叶变换(Fast Fourier Transform, FFT)和相干积累处理, 获取其在距离-多普勒(Range-Doppler, RD)域的二维分布, 进而利用2层CNN算法实现对手势动作的自动特征提取与识别。利用实测数据分析以及与传统基于运动轨迹的动态时间规划(Dynamic Time Warping, DTW)法的结果进行比较, 验证了本文方法在雷达手势动作识别应用中的有效性。

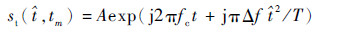

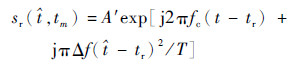

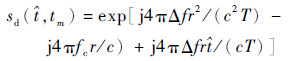

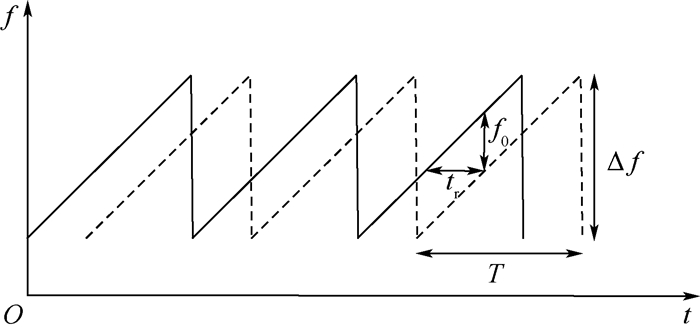

1 LFMCW雷达信号的脉冲多普勒处理方法 LFMCW雷达具有结构简单、分辨率高、抗杂波能力强等特点, 并且通过去斜以及快时间和慢时间域上的FFT分析, 可获得目标距离和多普勒频率信息。设LFMCW雷达发射信号为

| (1) |

式中:

则回波信号可表示为

| (2) |

式中:A′为回波信号幅度; tr为延迟时间, 可表示为tr=2r/c, r为目标径向距离, c为光速。

在此基础上, 以st(

| (3) |

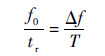

考虑目标静止, 则可得差频输出信号频率f0与目标径向距离r的关系为

| (4) |

因此, 利用快时间域FFT处理, 可获得手势目标的实时径向距离信息。该过程如图 1所示, 其中, 横坐标为快时间t, 纵坐标为频率f。观察可知, f0、tr、Δf和T之间明显满足:

| (5) |

|

| 图 1 LFMCW雷达测距示意图 Fig. 1 Schematic of range measurement by LFMCW radar |

| 图选项 |

将tr=2r/c代入式(5), 所得结果与式(4)结果相同。在此基础上, 对各距离单元内的基带信号做慢时间域的FFT处理, 进而可得回波信号在RD域的能量分布, 即雷达手势目标的二维RD像结果。

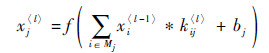

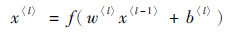

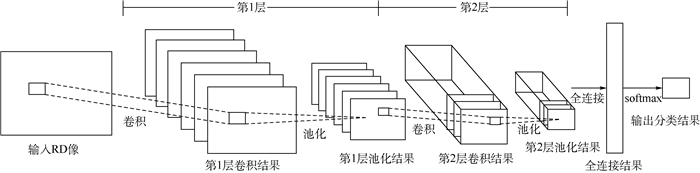

2 基于卷积神经网络的分类器 典型的CNN主要用于识别具有位移、缩放情况的二维图形。CNN避免特征提取, 仅通过数据训练学习特征。此外, 由于同一特征映射面上的神经元权值相同, 所以该网络可以并行学习, 节省资源。本文方法使用了11×11和4×42个卷积层进行特征选择, 2个2×2池化层进行降维, 之后进行全连接与softmax分类处理。与一般神经网络相同, 其主要分为正向传播和反向传播2部分。在正向传播中, 假设CNN第l层输出特征图为xj〈l〉, j表示特征图序号。该输出特征图可表示为

| (6) |

式中:Mj为选择的输入特征图组合; kij为输入第i种特征图与输出第j种特征图之间连接的卷积核; bj为第j种特征图偏置; f()为激活函数; “*”表示卷积运算。本文采用典型的sigmoid函数。

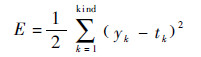

在反向传播过程中, 通过多次迭代使网络预测与实际正确情况更接近。以卷积层为例, 定义平均误差代价函数为

| (7) |

式中:yk为预测输出标签; tk为正确标签; kind为识别种类数量。迭代目标为使E逐渐减小。

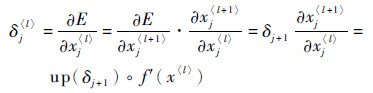

定义节点灵敏度为

| (8) |

每层中每个输入特征图的节点灵敏度不同, 例如在第l层卷积层中, 有

| (9) |

式中:up(·)表示上采样; “。”表示每个元素相乘。

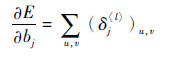

为了对核函数和偏置进行迭代更新, 所以需要分别求出平均误差代价函数对核函数和偏置的偏导数:

| (10) |

| (11) |

式中:(pj〈l-1〉)u, v为x〈l-1〉j在与kij做卷积时每一个子模块; (u, v)为该模块的中心位置。

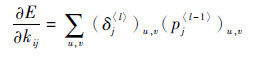

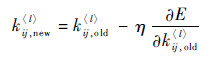

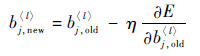

核函数和偏置的梯度下降更新公式为

| (12) |

| (13) |

式中:η为学习率。

在全连接层部分, 需要更新的变为权值w和偏置b, 且其输入与输出的关系为

| (14) |

因此, 节点灵敏度可表示为

| (15) |

通过多次迭代更新, 可使平均误差代价函数达到最小。

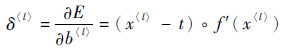

最后进行softmax分类, 其为一个类似逻辑回归的多分类问题, 即标签y可取k个不同的值。假设其训练集为{(x(1), y(1)), (x(2), y(2)), …, (x(m), y(m))}, p(y=j|x)表示给定测试输入数据为x时估测所属类别y为j的概率值, 则设softmax的分类函数为

| (16) |

式中:θ1, θ2, …, θk为模型的参数。

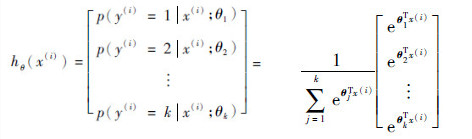

对应softmax回归中, 代价函数为

| (17) |

式中:

| (18) |

同样利用梯度下降法获得J(θ)最小值对应的θ, 将θ值代入式(16), 对应概率值最大的一项作为最终分类结果。

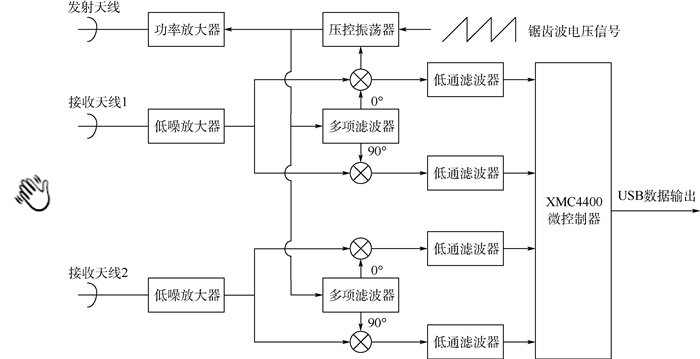

3 雷达系统及测量场景 为了验证CNN对手势动作的识别能力, 本文采用基于Infineon BGT24MTR12射频前端的工业雷达传感器[18]进行数据采集, 主要结构如图 2所示。压控振荡器通过锯齿波电压进行调频控制, 且扫频周期T=2.50 ms; LFMCW雷达发射信号载波频率fc≈24.13 GHz, 扫频带宽Δf≈ 455 MHz, 采样频率fs=48 kHz; 相干积累时长为80 ms, 即对同一距离单元内连续32个慢时间域信号采样点进行FFT处理。需要说明的是, 由于本文方法仅需要手势回波的距离和多普勒信息, 因此, 实验数据针对单接收通道的同相(I路)和正交(Q路)2路信号进行采集。

|

| 图 2 用于手势动作识别的24 GHz LFMCW雷达实验系统结构 Fig. 2 Block diagram of 24 GHz LFMCW radar experimental system for hand gesture recognition |

| 图选项 |

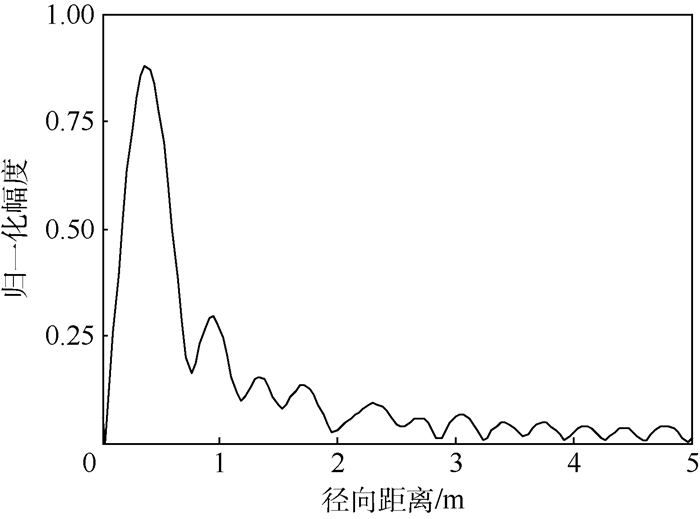

图 3给出了手势向前运动时的回波中频信号。观察可知, 一次调频周期内的采样点数为120, 与实验系统设置参数相符; 另一方面, 此时手势与雷达天线距离约为40 cm, 因此根据式(4)及调频周期, T时间内中频信号的周期数约为1。在此基础上, 图 4给出了基于快时间FFT处理的手势目标径向距离。

|

| 图 3 手势向前动作时的雷达回波中频信号 Fig. 3 Radar intermediate-frequency echoes of hand pushing |

| 图选项 |

|

| 图 4 基于快时间FFT的手势目标径向距离 Fig. 4 Radial distance of gesture target based on FFT in fast-time domain |

| 图选项 |

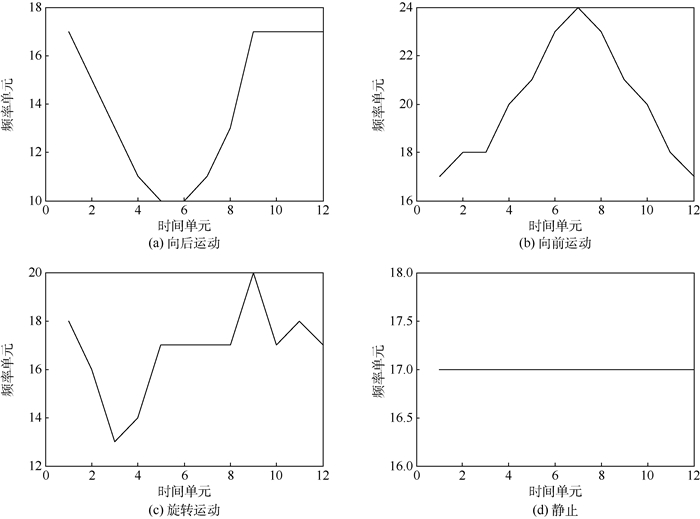

4 实验结果与分析 本文通过24 GHz雷达实验系统采集并生成4种手势动作的RD像, 包括向后运动、向前运动、旋转运动和静止。图 5给出了各手势动作的RD结果样图, 其尺寸大小为32×120。

|

| 图 5 4种手势动作的RD测量结果 Fig. 5 RD measurement results of four hand gestures |

| 图选项 |

为了更好地验证CNN处理方法的识别性能, 本文将与传统基于手势轨迹的DTW[19]法进行对比。首先, 对每个动作的12帧图像分别提取单一位置的多普勒序列; 其次, 将该12列数据按时间信息融合为一个矩阵, 矩阵大小为32×12;最后, 提取每个时间点能量最大位置处置1, 其他位置处置0, 可得到不同动作的频率变化轨迹。分别选择每个动作的运动模板, 如图 6(a)~(d)所示。其中, 纵坐标为具有最大能量的频率情况。

|

| 图 6 运动轨迹模板 Fig. 6 Templates of moving tracks |

| 图选项 |

图 6中, 向后动作的运动轨迹呈现向下弯曲情况, 如图 6(a)所示。这与实际情况中, 手相对雷达的速度变化情况一致。即从速度为0开始, 进行加速运动, 之后减速至0。同理, 向前运动与向后运动仅为运动速度方向相反, 所以运动轨迹呈现多条向上弯曲的情况, 如图 6(b)所示。对于旋转而言, 手相对雷达方向速度基本为0, 但也可能存在小部分时刻存在相对速度, 所以可能出现如图 6(c)所示局部模糊情况。而静止情况下, 手没有任何动作, 所以不会出现速度随时间变化的情况, 呈现结果应为图 6(d)所示的一条直线。在识别过程中, 对每个待识别的测试样本与4个模板分别进行DTW处理, 之后求出处理后模板与待识别样本之间的距离, 该样本与某一模板距离最小则说明其属于对应模板类。本组实验测试样本数为2 000组。

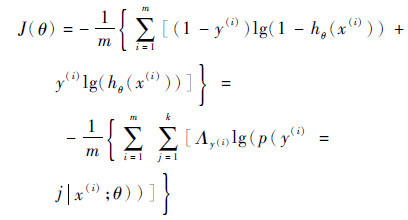

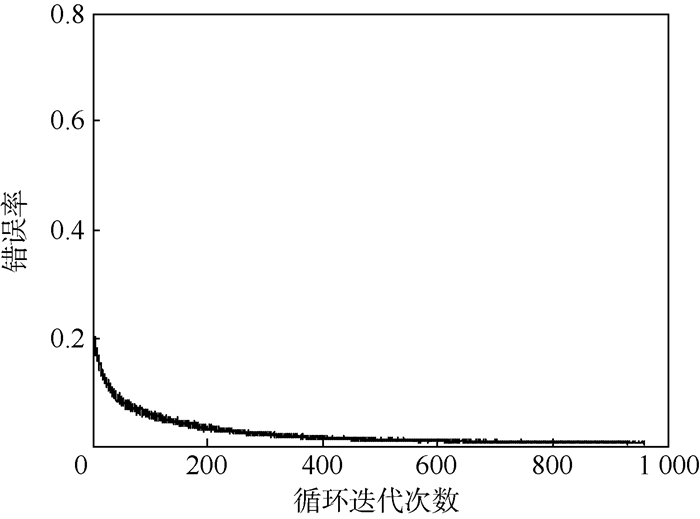

对4组动作的RD像进行本文提出的CNN分类处理, 具体CNN架构如图 7所示。其由2层结构组成, 而每层分别包括卷积层和池化层。其中, 2层卷积核大小分别为11×11和4×4, 之后进行全连接以及softmax分类, 最终输出分类结果。该实验的训练样本数为6 000组, 测试样本为2 000组。训练误差变化情况如图 8所示。可知, 系统已训练到稳定状态, 且训练误差维持在0.02~0.03。

|

| 图 7 基于RD像的CNN架构示意图 Fig. 7 Schematic diagram of CNN architecture used in RD image |

| 图选项 |

|

| 图 8 训练错误率曲线 Fig. 8 Error rates in training |

| 图选项 |

为了比较2种方法的识别准确率, 识别结果如表 1所示。观察可知, 在识别4种典型手势动作时, 除静止外, 本文方法的识别准确率明显高于DTW法, 且全局识别准确率可提高约0.138。

表 1 基于测试数据的手势识别准确率 Table 1 Testing accuracy of hand gesture recognition

| 方法 | 准确率 | 全局准确率 | |||

| 向后运动 | 向前运动 | 旋转运动 | 静止 | ||

| DTW | 0.816 7 | 0.913 3 | 0.240 0 | 1.000 0 | 0.740 0 |

| 本文 | 0.932 0 | 0.920 0 | 0.816 0 | 0.844 0 | 0.878 0 |

表选项

5 结论 本文研究了一种基于LFMCW雷达RD信息和CNN的手势动作识别方法。实验结果表明:

1) 该方法适用于通用的24 GHz工业雷达系统, 通过多普勒信息的引入可降低对系统带宽的要求。

2) 由于典型手势目标RD像集中在有限的RD单元中, 通过2层卷积处理即可实现有效特征表述, 从而利用全连接与softmax分类器能够对向后运动、向前运动、旋转运动和静止4种手势动作进行识别。

3) 该方法可针对单帧RD像进行识别, 具有较好的实时性, 且与基于手势轨迹分析的DTW法相比, 全局识别准确率可提升约0.138。

参考文献

| [1] | 张诗潮. 基于Kinect的手语教学系统设计研究[D]. 上海: 华东师范大学, 2014. ZHANG S C. Design research in Kinect based sign-language teaching system[D]. Shanghai: East China Normal University, 2014(in Chinese). |

| [2] | 孙凯, 严潇然, 谢荣平. 基于手势识别的智能家居人机交互系统设计[J].工业控制计算机, 2014, 27(4): 54–56. SUN K, YAN X R, XIE R P. Design of man-machine interaction system in smart home[J].Industrial Control Computer, 2014, 27(4): 54–56.(in Chinese) |

| [3] | 万华根, 肖海英, 邹松. 面向新一代大众游戏的手势交互技术[J].计算机辅助设计与图形学学报, 2011, 23(7): 1159–1165. WAN H G, XIAO H Y, ZOU S. Hand gesture interaction for next-generation public games[J].Journal of Comouter-Aided Design & Computer Graphics, 2011, 23(7): 1159–1165.(in Chinese) |

| [4] | OLIVITO R S, STUMPO P, SURACE L. Glove-Talk:A neural network interface between a data-glove and a speech synthesizer[J].IEEE Transactions on Neural Networks, 1993, 4(1): 2–8.DOI:10.1109/72.182690 |

| [5] | STURMAN D J, ZELYZER D. A survey of glove-based input[J].IEEE Computer Graphics & Applications, 1994, 14(1): 30–39. |

| [6] | QUAM D L. Gesture recognition with a DataGlove[C]//Proceedings of Aerospace and Electronics Conference. Piscataway, NJ: IEEE Press, 1990, 2: 755-760. |

| [7] | WANG C, CANNON D J. A virtual end-effector pointing system in point-and-direct robotics for inspection of surface flaws using a neural network based skeleton transform[C]//Proceedings of IEEE International Conference on Robotics and Automation. Piscataway, NJ: IEEE Press, 1993, 3: 784-789. |

| [8] | BAUDEL T, BEAUDOUIN-LAFON M. Charade:Remote control of objects using free-hand gestures[J].Communications of the ACM, 1993, 36(7): 28–35.DOI:10.1145/159544.159562 |

| [9] | TRAVER V J, LATORRE-CARMONA P, SALVADOR-BALAGUER E, et al. Three-dimensional integral imaging for gesture recognition under occlusions[J].IEEE Signal Processing Le-tters, 2017, 24(2): 171–175.DOI:10.1109/LSP.2016.2643691 |

| [10] | SIMONYAN K, ZISSERMAN A. Two-stream convolutional networks for action recognition in videos[J].Advances in Neural Information Processing Systems, 2014, 1(4): 568–576. |

| [11] | WANG C, LIU Z, ZHAO J. Hand gesture recognition based on canonical formed superpixel earth mover's distance[C]//Proceedings of IEEE International Conference on Multimedia and Expo. Piscataway, NJ: IEEE Press, 2016: 1-6. |

| [12] | FAN T, MA C, GU Z, et al. Wireless hand gesture recognition based on continuous-wave Doppler radar sensors[J].IEEE Transactions on Microwave Theory & Techniques, 2016, 64(11): 4012–4020. |

| [13] | KIM Y, TOOMAJIAN B. Hand gesture recognition using micro-Doppler signatures with convolutional neural network[J].IEEE Access, 2016, 4: 7125–7130.DOI:10.1109/ACCESS.2016.2617282 |

| [14] | REN N, QUAN X, CHO S H. Algorithm for gesture recognition using an IR-UWB radar sensor[J].Journal of Computer & Communications, 2016, 4(3): 95–100. |

| [15] | LIEN J, GILLIAN N, KARAGOZLER M E, et al. Soli:Ubiquitous gesture sensing with millimeter wave radar[J].ACM Transactions on Graphics, 2016, 35(4): 1–19. |

| [16] | MOLCHANOV P, GUPTA S, KIM K, et al. Multi-sensor system for driver's hand-gesture recognition[C]//Proceedings of IEEE International Conference and Workshops on Automatic Face and Gesture Recognition. Piscataway, NJ: IEEE Press, 2015: 1-8. |

| [17] | MALYSA G, WANG D, NETSCH L, et al. Hidden Markov model-based gesture recognition with FMCW radar[C]//Proceedings of IEEE Global Conference on Signal and Information Processing. Piscataway, NJ: IEEE Press, 2016: 1017-1021. |

| [18] | Infineon Technologies AG. 24 GHz chipset-family for industrial applications[EB/OL]. [2017-06-08]. http://www.infineon.com/dgdl?folderId=db3a304344baa87a0144d47968a72df7&fileId=db3a304344baa87a0144d47b9a5e2df9. |

| [19] | EYE R M, DOMINGUEZ G, ESCALERA S. Feature weighting in dynamic time warping for gesture recognition in depth data[C]//Proceedings of IEEE International Conference on Computer Vision Workshops. Piscataway, NJ: IEEE Press, 2011: 1182-1188. |