|

| 图 1 背景分割效果Fig. 1 Background segmentation effect |

| 图选项 |

2) 虚拟化身的重叠.虚拟化身在场景中的位置是任意的,因此需要解决虚拟化身的重叠问题.系统中使用按照深度值逐点叠加的方式,对于双方图像的重叠部分,叠加后图像上的每个像素点,来自于双方原图像中深度值较小的一方,即与摄像头距离更近的一方.这种设计的优点在于,通信双方可以通过调节自身到显示屏幕的距离,实时改变双方虚拟化身重叠部分的层次效果.虚拟化身的叠加原理和效果如图 2所示.

|

| 图 2 视频虚拟化身的叠加Fig. 2 Overlay of video avatars |

| 图选项 |

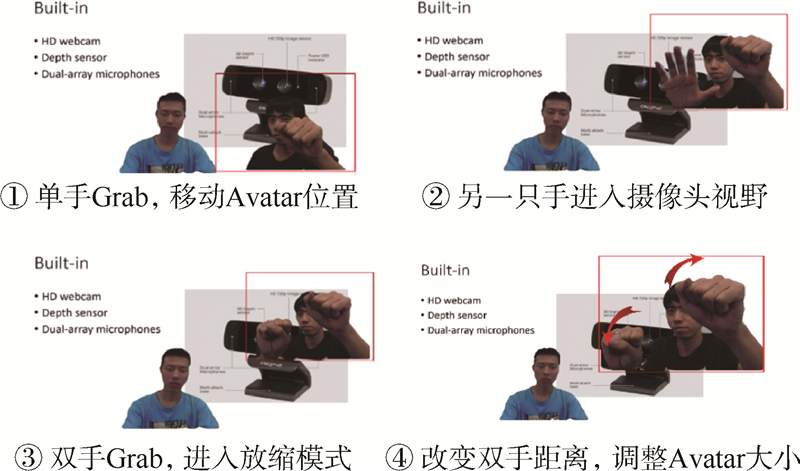

2.2.2 体感控制视频通信者需要利用虚拟化身来表达肢体语言,因此必须摆脱鼠标、键盘这类传统的命令输入方式.因此,本文系统将体感控制技术应用到视频协作中,通信者可以使用手势等特定的肢体动作,作为系统的输入与控制命令.基于深度信息,系统实现了对一些特定手势的识别,包括3种静态手势“Thumb up/down(拇指向上/下)、Big5(五指张开)和Peace(V字形)”以及6种动态手势“Wave(挥手)、Circle(画圈)、Swipe up/down/left/right(上下左右的摆手)、Grasp(抓)、Release(松)和Zoom in/out(放大缩小)”.同时,通过识别人的手掌和手指,可以获得手部的三维位置信息.基于手势识别与手部位置信息的获取,可以实现完全基于体感的系统控制.1) 虚拟化身的移动与放缩.以远程文件分享场景为例,通信者的虚拟化身可能会对文字内容产生遮挡,因此系统中设计了简单自然的手势,用以对虚拟化身的位置和大小进行调整(如图 3所示).

|

| 图 3 视频虚拟化身移动与放缩Fig. 3 Moving and resizing the video avatars |

| 图选项 |

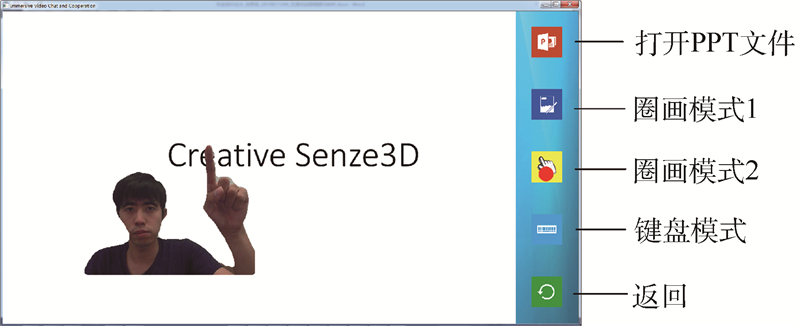

2) 流程切换与控制.在传统的视频协作系统中,需要通过鼠标选择菜单等操作来改变当前系统的状态.为了实现全手势控制,系统设计了手部控制菜单选择、全手势控制两种方式,实现了对系统的流程切换.第一种方式通过识别通信者的手部位置,将其手部的x、y坐标映射到窗口之上,通信者可以改变手部的位置来控制屏幕上的光标,实现与鼠标操作相同的菜单选择操作,如图 4所示,窗口右侧可滑出菜单项,圆形表示光标位置,光标在按钮上保持停留一段时间(2s)后表示点击.

|

| 图 4 基于菜单选择的流程控制Fig. 4 Flow control based on menu selection |

| 图选项 |

第二种方式是通过预先设置一些特定的手势,来实现流程的切换,如Thumb up表示切换为鼠标模式、Thumb down表示关闭鼠标模式等等.3) 演示文档的选择与播放.在远程文件分享场景下,系统设计了从利用文件选择器选择共享文件,到控制演示文档播放的全部手势控制,手势设计以简单自然为目标,使通信者易于掌握.手势控制指令如表 1所示.表 1 演示文档选择与播放的全手势控制 Table 1 Full set of gestures to control powerpoint selection and slideshow

| 对象 | 手势 | 功能 |

| 文件选择器 | Peace | 打开文件选择器 |

| Swipe left | 上级目录 | |

| Swipe right | 下级目录 | |

| Thumb up | 光标移动至上一个文件 | |

| Thumb down | 光标移动至下一个文件 | |

| Peace | 打开文件(放映PPT) | |

| Big5 | 关闭文件选择器 | |

| 演示文档 | Swipe left | 返回上一个动画 |

| Swipe right | 播放下一个动画 | |

| Swipe up | 上一页 | |

| Swipe down | 下一页 | |

| Big5 | 关闭 |

表选项

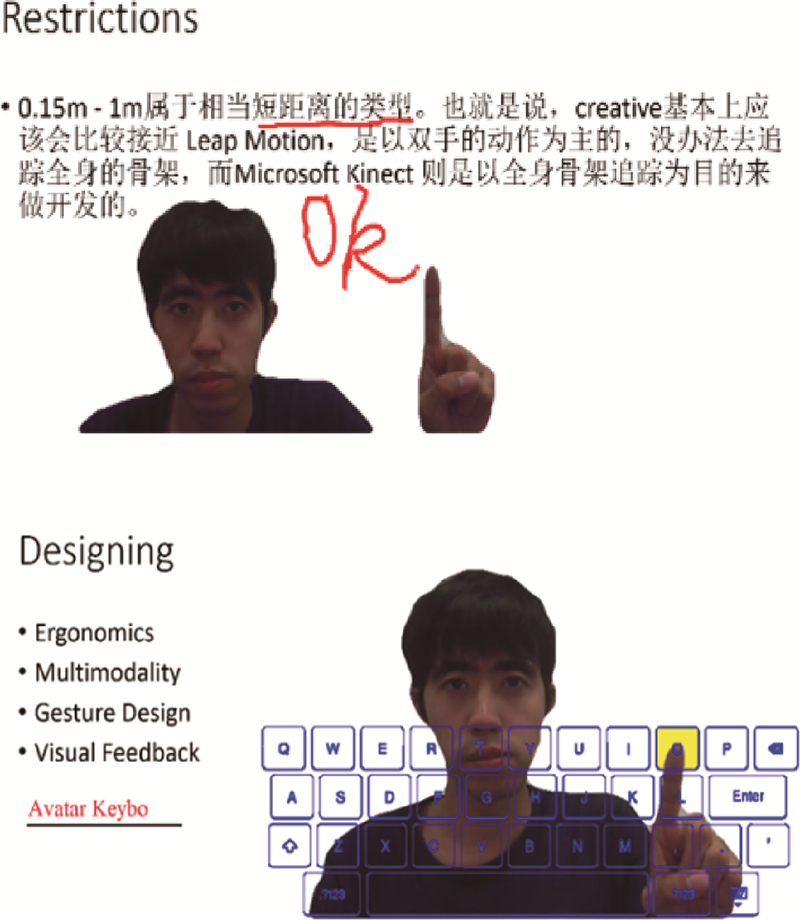

2.2.3 交互设计1) 虚拟化身与场景的交互.虚拟化身与场景完全融合,使得虚拟化身与场景之间的交互成为可能.在已获得通信者的手掌以及手指三维坐标的基础之上,通过将深度图映射到RGB图之上,可以得到虚拟化身RGB图像中手部的位置坐标.同时,在背景分割的过程中,也可以获得虚拟化身图像中的人物轮廓坐标.这样,就可以利用虚拟化身的身体信息,与虚拟场景进行直接、自然的交互.对于文件分享场景,如图 5所示,虚拟化身可以直接使用手指在文件上进行圈画与书写,同时也可以使用手指去点击场景中的虚拟键盘,完成精准的文字输入.

|

| 图 5 视频虚拟化身的手写与键盘点击Fig. 5 Hand-writing and keyboard-typing of video avatars |

| 图选项 |

对于远程游戏场景,如图 6所示,利用人物的轮廓信息,游戏双方均可以使用自己的身体轮廓来与虚拟球体进行碰撞,同时双方也可以借助球体完成一系列交互与协作任务.相对于文件分享场景,游戏场景更强调协作的实时性与同步性,将双方虚拟化身置于共同虚拟场景中的这种设计,满足远程协作所需实时性与同步性,拓展了远程协作的模式,增强了通信者的协作沉浸感.

|

| 图 6 虚拟化身使用身体轮廓的协作Fig. 6 Cooperations using avatars’ body contours |

| 图选项 |

2) 虚拟化身之间的交互.系统使用按深度值逐点叠加的方法,可以实现虚拟化身重叠区域的正确显示.利用这一特性,系统中可以实现虚拟化身的肢体接触,如握手(图 7)等.肢体接触在传统远程视频模式中无法实现,但却是人们在实际会议场景中频繁出现的交互方式.系统设计实现的肢体接触类型的交互,可以有效地提升通信双方的协作沉浸感.

|

| 图 7 视频虚拟化身之间的肢体接触Fig. 7 Body touch between video avatars |

| 图选项 |

事实上,系统中使用的背景分割算法基于深度阈值的设置,因此对于距离摄像头较近的其他物体,同样可以从背景中提取出来.所以系统也可以实现虚拟化身与远程真实物体的交互,如图 8所示,虚拟化身可以用手拿起通信对方摄像头视野内的杯子,手和杯子的重叠关系也可以完全正确地显示出来.

|

| 图 8 基于真实物体的远程交互Fig. 8 Remote interactions based on physical objects |

| 图选项 |

除了接触类型的交互方式以外,系统还可以实现虚拟化身之间对虚拟物体的传递.在图 9所示的远程文件共享场景中,一方的虚拟化身可以将自己手中虚拟的笔传递给另一方,完成协作任务.这同样是通信者不在同一空间内的传统视频通信模式无法实现的交互与协作方式.

|

| 图 9 虚拟物体的传递Fig. 9 Transfer of virtual objects |

| 图选项 |

3 系统实现本文系统使用Creative Senz3D深度摄像头,其图像采集帧率为30帧/s,彩色(RGB)图像分辨率为640像素×480像素,深度(Depth)图像分辨率为320像素×240像素,深度值的有效识别距离为0.15~1m.视频通信双方各使用一台计算机,通过USB外接一台Creative Senz3D摄像头作为3D图像的采集设备,双方通过接入互联网,实现远程视频通信协作.系统硬件设备如图 10所示.

|

| 图 10 系统硬件设备图Fig. 10 System hardware equipment diagram |

| 图选项 |

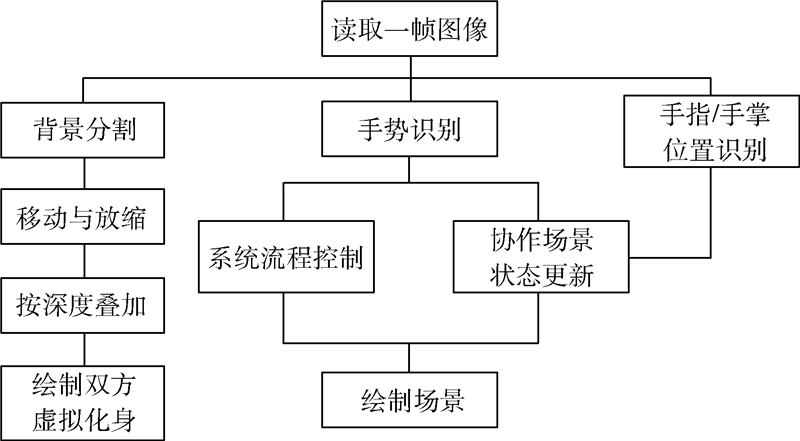

本文系统面向桌面系统平台,通过3D摄像头采集用户三维图像信息,使用背景分割、图像按深度逐点叠加、手势识别、手指位置识别等算法与技术,完成了“沉浸式”远程视频协作系统的具体实现,系统流程如图 11所示.

|

| 图 11 系统流程图Fig. 11 System flowchart |

| 图选项 |

4 实验评估为了对本文“沉浸式”系统进行验证与评估,设计并开展了20人规模的用户实验.具体形式为实验者两两一组,双方在不同房间内完成远程协作.实验分为两个场景,对于文件分享场景,实验者在接受一次系统演示之后,要求每人先按照既定流程“打开文件→控制播放→改变虚拟化身大小位置→键盘输入→圈画注释→传递虚拟铅笔→双方握手→关闭文件”操作一次,然后双方再使用系统自由交流、协作10min;对于游戏场景,在介绍游戏玩法之后,让双方进行游戏竞技,先得到15分(投入15个球,约10min)的实验者获胜.在两组场景的实验之间,要求实验者进行充分的休息;在实验后,通过填写问卷和访谈,记录实验者对系统的具体评价,包括对不同流程控制方法的满意度比较、对系统中人物真实感的保真度、虚拟化身与虚拟场景相融合的方案和交互方式效果的评价以及对系统的整体满意程度等.下面详细阐述实验所得到的评测结果.4.1 体感流程控制系统中的流程控制方式包括菜单选择方式与全手势控制两种.实验后要求实验者对比这两种流程控制方法的使用体验,对于7项不同的评测指标,实验者可以在“菜单选择方式更优”、“全手势控制方式更优”和“二者基本相同”这3种选项中进行自由选择.根据实验者的问卷反馈,通过统计分析,得出的对比结果如表 2所示.其中更优的结果用加粗字体来表示.表中比例不计入实验者“二者基本相同”的中立选择.表 2 两种流程控制方法对比结果 Table 2 Results of comparison between two flow control methods

| 指标 | 菜单选择方式 | 全手势控制方式 |

| 操作难度小 | 1/20 | |

| 劳累感弱 | 2/20 | |

| 自然、直观 | 2/20 | |

| 响应速度快 | 0/20 | |

| 可扩展性强 | 1/20 | |

| 鲁棒性好 | 1/20 | |

| 学习和记忆负担小 | 0/20 | |

| 整体评价高 | 7/20 | 8/20 |

表选项

由实验对比结果可知,对于菜单选择方式,使用者不需要记忆额外的手势,只需使用完全一致的控制方式,即可实现流程的切换,且可扩展性更强;而对于全手势控制方式,用户操作更加自然、直观,操作难度更小,流程切换速度也更快,在熟练掌握系统手势之后操作更加简单快捷.系统通过同时提供这两种流程控制方法,结合二者的优点,为用户的流程切换控制提供了两种互补的选择,绝大部分实验者(17/20,85%)认为同时提供以上两种流程切换方式,比单独使用其中任何一种都要更舒适、有效.4.2 沉 浸 感结合“沉浸式”远程视频协作的3项设计目标,实验后调查了系统对实验者协作沉浸感的提升效果,得到了以下的反馈结果.4.2.1 真实感实验者对系统中人物的真实感普遍表示认可(19/20,95%),认为与传统的视频通信功能相比,本系统没有任何真实感的缺失.此外实验者表示,真实感是视频通信最基本的要求,通过图像来确认通信对象是视频通信的第一步[17],利用真实的人物图像来辅助表达非语言信息是视频通信的价值所在.4.2.2 与虚拟场景的融合对于系统中虚拟化身与虚拟场景相结合的设计,实验者全部认为这是一种有实用价值且有趣味性的设计理念(20/20,100%).尤其对于远程游戏场景,实验者认为系统提供了一种更好的远程游戏模式,实验者在游戏过程中也的确体验到了相比传统网络游戏更强烈的沉浸感.某实验者表示:“我感觉我们两个好像真的在同一个地方玩游戏,我打出去的球碰到了他的身体可以立刻反弹回来,他也同时能够看到整个过程,还有表情和动作的直接反馈,觉得我们完全同时同地在做同一件事.”4.2.3 交互方式对于系统中设计的几种新型交互方式,实验者也给出了相应的反馈.其中,对基于虚拟化身图像重叠所产生的交互方式,某实验者这样评价:“我认为这种叠加方式潜在的应用场景可能在于,远程通信双方可以在视觉上实现一些本不可能实现的、带有趣味性的显示效果,这对于远程合影或者趣味聊天应该具有一定的应用价值,但是想创造好的显示效果的难度很大,双方配合产生一个特定的效果需要一定的时间.”而对于基于虚拟物体传递的交互方式,实验者的评价很高,认为这是基于窗口的视频聊天无法实现的交互方式.对于利用虚拟化身手部和身体与场景交互的模式,实验者认为相比于空中手写这类需要高精度控制的交互形式,对精度要求不是很高的、类似于系统中键盘点击的交互形式,用户操作起来会更简单,而且不会产生过度的疲劳感.4.3 综合评价在用户实验与调查中,绝大部分实验者(18/20,90%)对本文设计提出的视频通信模式表示认可.这从一定程度上肯定了本文系统的价值与实用性.结合实验者的调查反馈,并考虑系统中存在的一些设计上和技术上的问题,给出对系统的综合评价.4.3.1 系统的优点与贡献首先,基于真实图像的虚拟化身,这种人物的呈现形式,在虚拟现实技术中有着非常重要的价值和丰富的应用场景.虚拟化身将人“带入”了屏幕中的虚拟世界,使得人物能够与虚拟场景相结合,实现人物与场景的融合、控制与交互.系统中设计的基于虚拟化身手指位置的圈画书写、键盘输入等功能,就是虚拟化身在虚拟现实技术中的一种典型应用模式.同时,将远程多人的虚拟化身置于共同的虚拟场景之下,拓展了远程视频协作中的交互方式.得益于虚拟化身的存在,远程通信者之间可以实现实时的、同步的、基于人物肢体的交互.系统设计的游戏场景中,通信者可以利用各自的肢体与虚拟的球进行交互,文件分享场景中通信者可以实现虚拟物体的传递,这些都是虚拟化身与虚拟场景融合所创造出的新的远程协作交互模式.此外,本文设计的完全基于手势识别的系统控制方法,为桌面系统脱离鼠标和键盘的束缚提出了一种解决方案.基于菜单选择和手势指令设计的流程切换方法,基本可以实现系统的全部流程控制;同时对于输入精度要求不是很高的任务,手势控制基本上也可以覆盖用户的全部需求.4.3.2 系统的不足首先,由于3D摄像头存在视角和距离的限制,使用者必须保证自己的身体(包括执行交互任务的手)位于摄像头的视野范围之内,且在摄像头的可识别距离(约1m)以内,因此系统只能面向桌面系统,且只能在一定范围内完成识别与交互.其次,对于虚拟化身图像的重叠问题,本文给出了按深度逐点叠加的方案.这种设计方案从理论上完全正确,但是正如实验中实验者陈述的那样,由于双方不在同一个实际地点,对于距离的感觉又无法到达很高的精度,且又不存在任何肢体接触的反馈,因此双方很难主动地实现复杂的图像重叠.最后是手势控制造成的疲劳感.本文系统面向桌面平台,操作者可以将肘部架在桌面上,完成绝大部分的手势控制,这从一定程度上减轻了用户疲劳感.然而系统中也存在着一些导致用户产生疲劳的手势控制,如菜单选择、图像的移动与放缩等,同时系统中设计的需要精确手部控制的操作,包括空中手写、键盘点击等,长期操作都可能导致使用者疲劳,这也是利用手势操作自然性的一种代价.5 结 论1) 分类、总结分析了现有视频协作系统的优缺点,提出“沉浸式”视频协作系统的3项设计目标:包括人物与场景的融合、人物真实感的保持和拓展自然交互方式.2) 设计并实现了基于视频虚拟化身的远程视频协作系统,拓展了远程协作的交互模式:包括虚拟化身的肢体接触、虚拟物体传递、远程多人交互性游戏与协作等,实现了通信者之间,以及通信者与场景之间的自然的、有沉浸感的交互.3) 通过用户实验验证了本文系统的有效性与实用性,实验结果证明,本文设计的基于视频虚拟化身的远程视频协作模式,在拓展传统远程协作模式的基础之上,能够有效地提升远程协作的沉浸感.

参考文献

| [1] | Isaacs E A, Tang J C.What video can and cannot do for collaboration:A case study[J].Multimedia Systems, 1994, 2(2):63-73. |

| Click to display the text | |

| [2] | Tang J C, Isaacs E A.Why do users like video?[J].Computer Supported Cooperative Work(CSCW), 1992, 1(3):163-196. |

| Click to display the text | |

| [3] | Nechvatal J.Immersive ideals/critical distances[M].Saarbrücken:LAP Lambert Academic Publishing, 2009:26-136. |

| [4] | Tang J C, Wei C, Kawal R.Social telepresence bakeoff:Skype group video calling, google+ hangouts, and microsoft avatar kinect[C]//Proceedings of the ACM 2012 Conference on Computer Supported Cooperative Work Companion.New York:ACM, 2012:37-40. |

| Click to display the text | |

| [5] | Steuer J.Defining virtual reality:Dimensions determining tele-presence[J].Journal of Communication, 1992, 42(4):73-93. |

| Click to display the text | |

| [6] | 孙立峰, 李放, 钟玉琢, 等.基于多视点视频的虚拟会议显示与合成[J].电子学报, 2004, 33(2):193-196. Sun L F, Li F, Zhong Y Z, et al.Multiview video based virtual teleconferencing synthesizing[J].Acta Electronica Sinica, 2004, 33(2):193-196(in Chinese). |

| Cited By in Cnki (11) | |

| [7] | Kim K, Bolton J, Girouard A, et al.Telehuman:Effects of 3D perspective on gaze and pose estimation with a life-size cylindrical telepresence pod[C]//Proceedings of the SIGCHI Conference on Human Factors in Computing Systems.New York:ACM, 2012:2531-2540. |

| Click to display the text | |

| [8] | Boyle M, Greenberg S.The language of privacy:Learning from video media space analysis and design[J].ACM Transactions on Computer Human Interaction(TOCHI), 2005, 12(2):328-370. |

| Click to display the text | |

| [9] | Leigh J, Johnson A E, Vasilakis C A, et al.Multi-perspective collaborative design in persistent networked virtual environments[C]//Proceedings of the IEEE Virtual Reality Annual International Symposium.Piscataway, NJ:IEEE Press, 1996:253-260, 271-272. |

| Click to display the text | |

| [10] | Junuzovic S, Inkpen K, Tang J, et al.To see or not to see:A study comparing four-way avatar, video, and audio conferencing for work[C]//Proceedings of the 17th ACM International Conference on Supporting Group Work.New York:ACM, 2012:31-34. |

| Click to display the text | |

| [11] | Han J, Smith B.CU-SeeMe VR immersive desktop teleconferencing[C]//Proceedings of the Fourth ACM International Conference on Multimedia.New York:ACM, 1997:199-207. |

| Click to display the text | |

| [12] | Lee S Y, Kim I J, Ahn S C, et al.Toward immersive telecommunication:3D video avatar with physical interacttion[C]//Proceedings of the 2005 International Conference on Augmented tele-existence.New York:ACM, 2005:56-61. |

| Click to display the text | |

| [13] | Ogi T, Yamada T, Tamagawa K, et al.Immersive telecommunication using stereo video avatar[C]// Proceedings of the IEEE Virtual Reality Annual International Symposium.Piscataway, NJ:IEEE Press, 2001:45-51. |

| Click to display the text | |

| [14] | Insley J A, Sandin D J, DeFanti T A.Using video to create avators in virtual reality[C]//ACM SIGGRAPH 97 Visual Proceedings:The Art and Interdisciplinary Programs of SIGGRAPH'97.New York:ACM, 1997:128. |

| Click to display the text | |

| [15] | Porter T, Duff T.Compositing digital images[C]//ACM Siggraph Computer Graphics.New York:ACM, 1984, 18(3):253-259. |

| Click to display the text | |

| [16] | Forrest A R.On the rendering of surfaces[C]//Proceedings of the 6th Annual Conference on Computer Graphics and Interactive Techniques.New York:ACM, 1979, 13(2):253-259. |

| Click to display the text | |

| [17] | Yura S, Usaka T, Sakamura K.Video avatar:Embedded video for collaborative virtual environment[C]//IEEE International Conference on Multimedia Computing and Systems.Piscataway, NJ:IEEE Press, 1999, 2:433-438. |

| Click to display the text |