近年来可以将图像去雾方法分为两类:基于图像处理的雾天图像增强、基于物理模型的雾天图像复原。图像增强的方法忽略图像退化的因素,可增强雾天图像清晰度,将图像细节信息突出出来,但会使细节发生一些缺失。图像复原的方法针对雾天图像降质过程,建立退化物理模型,反演退化过程,从而获得无雾图像。基于物理模型,得到的去雾效果更自然,信息损失较少。

基于图像处理的图像去雾方法包括直方图均衡化增强[1-3]、同态滤波[4]、小波变换[5]、Retinex[6]算法等。去雾效果较好且应用广泛的去雾方法主要有:①限制对比度自适应直方图均衡算法。文献[2]提出了一种限制对比度自适应直方图均衡算法 (Contrast Limited Adaptive Histgram Equalization, CLAHE),通过限制利用限制图像局部直方图的高度,使截取高度大于设定阈值的直方图,使截取的部分均匀分布于总体的图像灰度区间内,进而保证总体直方图面积的大小一致,能够有效抑制噪声,避免对比度过高。文献[7]在CLAHE算法的基础上,通过计算白平衡图像的显著图,进一步强化边缘信息。②Retinex算法。Retinex是一种描述色彩恒常性的模型,可以应用于图像纹理增强、色彩保真等方面。基于Retinex算法得到的去雾图像具有相对较高的局部对比度和较小的色彩失真。

基于物理模型的图像去雾方法包括基于偏微分方程[8-9]、基于深度关系[10-13]、基于先验信息[14-16]的去雾方法等。典型的几种去雾方法有:①基于偏微分方程的方法可以有效修正边界区域,明显改善视觉效果。文献[8]基于偏微分方程对图像进行去雾,通过大气散射模型,生成图像能量最优化模型,推导出图像景深和梯度的偏微分方程,修复了图像复原的不确定性。②基于深度关系的方法借助晴天和雾天图像,计算各点深度比关系,结合大气散射模型实现图像复原。文献[17]提出了一种基于深度的对比度拉伸变化算法 (DCST),方法简单且实时性较好。但基于深度关系的方法存在颜色过饱和、计算过程复杂等问题。③基于先验信息的方法可以获得较高的对比度和清晰化效果。在先验信息的基础上可运用均值滤波、中值滤波等方式,进一步改善图像质量。然而基于先验信息的方法会产生色彩过于饱和、运算过程耗时复杂等问题。

对于以上方法存在的问题,并考虑无人机图像特性,本文提出了一种新的基于图像增强的无人机侦察图像去雾方法,利用对原雾天无人机航拍图像分别进行白平衡和对比度增强的操作,基于图像融合和自动色阶处理,最终得到复原图像。以往涉及图像融合的去雾文献中,都采用复杂耗时的多尺度图像融合算法,权重图的选取也较为复杂,而这些文献之所以采用权重图是因为单幅图像的雾气浓度不同、景深不同,利用权重图可以增强图像雾气较浓区域的细节信息。而针对无人机侦察图像,单幅图像的雾气浓度大体相同、景深相对于较大的成像距离也大体相同。所以本文的方法忽略了权重图的选取,可以将权重仅设为一个常数,极大地增加了处理效率。实验证明,该方法具有良好的实时性和广泛的适用性,不仅适用于图像去雾,也适用于粉尘烟雾等环境下的图像增强。

1 融合输入图 本文的去雾方法仅通过单幅无人机侦察图像即可估算相关输入图来进行有效的去雾处理。最终去雾的效果主要取决于是否选取了合适的输入图。首先对有雾的无人机侦察图像进行白平衡处理的主要目的是消除色偏,通过消除大气光造成的色彩偏差,来改善图像的视觉效果。针对单幅图像,人眼观测到的物体的颜色不仅取决于该物体的反射特性,还由照射物体的光线的颜色决定。利用白平衡算法,可以消除光源因素对物体颜色的影响,从而获得经典光源下物体的颜色。从广义的角度来讲,白平衡算法就是讲在未知光源下拍摄到的物体的色彩,转换成在某一经典光源下物体的颜色,从而达到色彩一致性。

利用白平衡图像作为融合的输入图仅能在一定程度上消除图像的色偏问题,还需要利用另一输入图来增强原有雾图像的对比度。

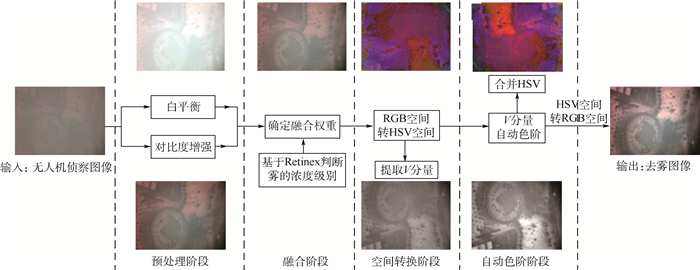

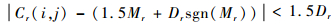

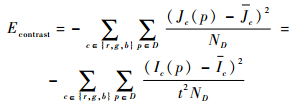

2 基于图像增强的去雾方法 无人机由于自身特性,成像设备和成像目标距离很远,图像景深相对于成像距离变化较小。本文针对这一特性,基于图像融合,从图像处理的角度提出了一种新的基于图像增强的无人机侦察图像快速去雾方法。方法流程图如图 1所示。本文的方法介绍分为以下4个方面:①基于动态阈值的白平衡图像的获取;②基于代价函数的对比度增强图像的获取;③白平衡图像和对比度增强图像的融合;④将融合后的图像进行颜色空间转换,将HSV空间的V分量进行自动色阶处理,最终得到复原图像。

|

| 图 1 本文去雾方法流程图 Fig. 1 Proposed dehazing method flowchart |

| 图选项 |

2.1 基于动态阈值的白平衡 本文获取白平衡图像的方法是基于文献[18]提出的动态阈值算法。算法主要分为2个步骤:白点检测和白点调整。该算法采用一个动态的阈值来检测白点。

在白点检测过程中,通过对图像的YCbCr空间的分析,可以发现某一块接近白色的区域包含白色参考点。因此可以通过对图像的分块找到白色参考点。首先将图像从RGB空间转换至YCbCr颜色空间。为了增强算法的鲁棒性,将图像以4:3的宽高比分成12部分进行分块处理,对每个块分别计算Cb分量、Cr分量的平均值,分别记为Mb、Mr,然后按照式 (1) 和式 (2) 分别计算每个块的Cb分量、Cr分量的绝对差的累计值,分别记为Db、Dr:

| (1) |

| (2) |

式中:N为每个块的像素个数;Cb(i, j) 和Cr(i, j) 为像素点 (i, j) 的色度值。

如果计算得到某块的Db、Dr的值偏小,那么表明该块的颜色变化量较小,分布较均匀,影响图像整体的白平衡,所以忽略该块,避免该块对整幅图像的统一色调造成的影响。然后判定每个块的近白区域 (near-white region),判定准则如下:

| (3) |

| (4) |

满足以上准则的点为候选白色参考点。根据亮度值大小,选择近白区域中亮度值为前10%的参考点作为最终的白点。

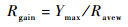

然后根据选定的参考点对整幅图像进行白点调整。分通道计算白点亮度值的平均值,分别记为Ravew、Gavew、Bavew,根据式 (5)~式 (7) 计算各个通道的增益:

| (5) |

| (6) |

| (7) |

式中:Ymax表示YCbCr颜色空间中Y分量在整幅图像中的最大值,利用亮度的最大值得到各个通道增益,以维持整幅图像的亮度保持不变。

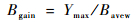

最后根据Von Kries颜色校正模型 (Von Kries diagonal model),调整图像的每个像素值,如式 (8)~式 (10) 所示:

| (8) |

| (9) |

| (10) |

式中:R、G、B为图像在原始RGB颜色空间中各通道的值。

2.2 基于代价函数的对比度增强 利用白平衡图像作为融合的输入图仅能在一定程度上消除图像的色偏问题,还需要利用另一输入图来增强原有雾图像的对比度。

本文获取对比度增强的图像的方法是基于文献[19]提出的对比度增强算法。该算法基于代价函数,提出了一种新的得到粗透射率图的方法。

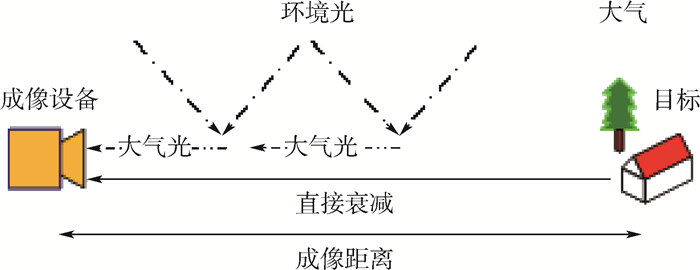

McCartney[20]根据Mie散射理论,提出景象的成像原理可用以下2个模型描述:入射光衰减 (direct transmission) 和大气光成像模型 (airlight),如图 2所示。

|

| 图 2 大气散射模型示意图 Fig. 2 Schematic diagram of atmospheric scattering model |

| 图选项 |

根据雾霾天气下大气散射模型,成像设备所拍摄的图像可表示为

| (11) |

式中:I(p) 为原有雾图像; J(p) 为清晰无雾图像; A为天空亮度 (大气光); t(p) 为反射光的透射率。

大多数去雾方法求取大气光的方法往往都是将大气光估计为一幅图像中最亮的像素值,但是,当场景中的物体亮度大于大气光时,可能导致大气光的不良选取。而在有雾区域像素值的变化量较小,比如天空。此外,该算法提出了一个基于四叉树细分的分层搜索方法。利用递归的方式使输入图像分为4个矩形区域,接着针对强度最大的像素值的区域继续分块,预先指定一个阈值,不断重复以上过程直至被选定区域的大小小于该值。在被选定的区域内,选择使距离‖(Ir(p), Ig(p), Ib(p))-(255, 255, 255)‖最短的颜色特征向量为大气光。

均方误差 (MSE) 对比度[21]能够用于反映某一图像块像素值的变化程度,如式 (12) 所示:

| (12) |

式中:c∈{r, g, b}为颜色通道;Jc(p) 为复原图像;Jc为Jc(p) 的平均值;N为图像块像素数目。

由大气散射模型式 (11) 可得到

| (13) |

则式 (12) 可以改写为

| (14) |

式中:Ic为Ic(p) 的平均值。从式 (14) 中可以得到均方误差对比度是t的递减函数。

接下来算法通过每个图像块D的3个颜色通道均方误差对比度的和的负数描述了对比度代价Econtrast的定义:

| (15) |

式中:ND为图像块D中的像素数目。因此,通过最小化Econtrast,可以最大化均方误差对比度。

2.3 图像融合 以往涉及图像融合的去雾文献[22-24]均采用拉普拉斯等多尺度融合算法,权重图的选取也较为复杂,而这些算法之所以采用权重图是因为单幅图像的雾气浓度不同、景深不同,利用权重图来增强图像雾气较浓区域的细节信息。但是,针对无人机侦察图像,单幅图像的雾气浓度大体相同、景深相对于较大的成像距离也大体相同。所以本文的算法里忽略了权重图的选取,而是将权重仅设为一个常数,极大增加了处理效率。关于权重的常数如何选取,如果侧重于得到图像的真实颜色,就让白平衡图像的比重占得大一些,如果侧重于图像对比度、想让色彩更丰富一些,就让对比度增强的图像的比重占得大一些。

当图像中的雾较重时,则侧重于图像对比度的提高。当图像中的雾较稀薄,则侧重于图像的白平衡处理。本文的算法判断图像雾气的薄厚程度。针对雾的不同级别给待融合图像赋予权重。

本文的方法基于K-means算法判断雾的浓度级别。K-means算法[25]是一种比较基本的聚类划分算法。本文方法以图像的亮度I、饱和度S作为图像特征,针对每一幅有雾的无人机侦察图像生成一个特征向量[I, S]T。从n幅图像的特征向量中随机选择5个特征向量为聚类初始的中心,再利用其他剩余的特征向量和这些聚类中心的距离,将其分别分配给最相近的聚类,计算得到每个新聚类的聚类中心,并重复这一过程若干次。则最后得到的5个聚类中心就是5个代表不同雾的级别的特征向量。将雾的级别从小到大分为0~4这5个级别,0表示基本无雾,4表示雾最浓。无人机侦察图像及其对应的雾的浓度级别、图像的融合权重如表 1所示。

表 1 图像融合权重对应雾浓度级别 Table 1 Image fusion weights and their corresponding grades of haze concentration

| 雾气浓度级别 | 对比度权重 | 白平衡权重 |

| 0 | 0 | 1 |

| 1 | 0.2 | 0.8 |

| 2 | 0.4 | 0.6 |

| 3 | 0.6 | 0.4 |

| 4 | 0.8 | 0.2 |

表选项

当输入一幅图像x的对比度增强图像和白平衡图像时,先判断该图像的特征向量[Ix, Sx]T与K-means算法的哪个质心最近,即判断该图像雾的浓度级别,然后由表 1获取该图像应该选取的融合权重,对该图像的2幅融合图像进行融合。

2.4 空间变换和自动色阶 当融合之后的图像得到了初步的复原,但是仅使用对比度增强图像和白平衡图像进行融合,并不能完全恢复图像的色彩和对比度,这是因为融合的过程中,权重的选取制约了图像的复原,一方权重的增加势必会削弱另一方的权重。因此,本文的方法对融合后的图像进行了空间转换和自动色阶的处理。首先将融合后的图像从RGB空间转换至HSV空间中。在RGB空间下处理图像,通过改变RGB的值来改变图像颜色,当RGB三通道的值之间的比例改变,将会导致图像颜色失真。HSV是根据颜色的直观特性创建的一种颜色空间模型。其中,H表示色调,S表示饱和度,V表示亮度。HSV颜色空间面向用户,适用于人类的视觉系统。因此很大一部分图像处理的操作是在HSV颜色空间中完成的。在HSV空间中,色调为颜色的基本特征属性,大部分由物体颜色的波长来决定;饱和度表示色彩的纯度;亮度的变化不会干扰其他属性之间的关系。研究发现,亮度为影响低照度图像的主要因素,物体固有属性不会改变[26]。在RGB颜色空间中,为了更好地恢复图像颜色,利用RGB三通道之间的比例因子来完成图像增强,减轻图像失真。在HSV空间里,亮度的改变会使图像视觉上产生颜色偏移,而并不会干扰图像的色调和饱和度。所以,仅需要通过增强该图像的亮度,就可以将图像清晰度提高,增强该图像的颜色。

RGB空间至HSV空间的转换关系如下[27]:

| (16) |

HSV空间至RGB空间的转换关系如下:

| (17) |

色阶表示256个灰度等级。色阶算法是利用调整图像的明暗程度,从而将图像对比度提升,以实现增视[28]。实际上,调整色阶算法的原理是将图像原来的直方图于256个灰度级别上进行重新分配的过程,利用拉伸图像的灰度直方图来提高对比度。

自动色阶是自动调整图像的明暗,使图像层次分明,从而方便用户对图像反常的暗区和亮区进行处理。自动色阶算法[29]流程图如图 3所示。首先,根据原图的直方图自动设置上下阈值。将0灰度级相应的像素点个数,与高阶灰度级相应的像素点个数逐个相加,直到整幅图像像素总数的0.5%小于累加值。设加和的灰度级里面最高的灰度级的值为下阈值。同时将255灰度级相应的像素点个数,与低阶灰度级相应的像素点个数逐个相加,直到整幅图像的像素总数的0.5%小于累加值。设加和的灰度级中最低的灰度级的值为上阈值。确定了上阈值和下阈值后,将原图像的直方图中小于下阈值的灰度值设为0,将原图像直方图中大于上阈值的灰度设为255。上下阈值之间灰度的分配方法如下:使原图像的直方图中位于上下阈值之间的部分向左移到最左端,再与比例系数255/d(d表示上下阈值差) 相乘,即可将移动的部分按照比例分配至0~255灰度级之间,进而得到新的直方图。

|

| 图 3 自动色阶算法流程图 Fig. 3 Auto levels algorithm flowchart |

| 图选项 |

综上,本文方法仅对V分量进行自动色阶处理。再将处理后的V与H、S分量融合,再转回RGB空间中,得到最后的去雾图像。

3 实验结果与分析 为了检验本文提出的无人机图像去雾方法的性能,应提供图像评价的功能,建立一套无人机图像质量评价体系。当前图像评价方式主要分为两类:主观评价、客观评价。由于观察者的个人因素对主观评价的影响较大,从而造成评价结果的不可靠。而客观评价方法相对可靠,根据对辅助参考信息的需求大小,可以分为全参考、半参考以及无参考,其中全参考和半参考的方式需要借助参考图像。而针对无人机图像的去雾效果评价,对同一场景下清晰无人机图像的再次获取有较大成本和难度,因此本文主要采取的是无参考的评价方法。基于视觉感知的去雾效果评价方法[30],试图从人类视觉感知的角度出发,构建一套无参考的去雾效果综合评价体系。本文参考该评价体系,同时根据图像色彩自然度指标 (Color Natural Index, CNI) 和图像色彩丰富度评价指标 (Color Colorfulness Index, CCI) 对去雾后的图像进行评价,判断本文去雾方法的有效性。

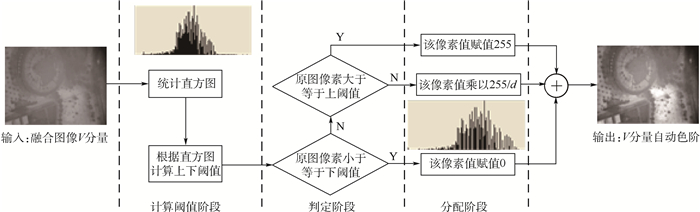

本文提出了基于图像增强的去雾算法,为了验证所提出算法的性能,本文将与其他典型去雾方法进行比较,并给出无人机雾霾图像的复原结果。本文算法实验对象为无人机中低空侦察图像集,图像大小为1 392像素×1 040像素,实验平台为Microsoft Visual C++6.0。图 4为从中选取的7幅图像的实验结果。从图 4中可以看出,其他方法的色彩有一定程度的失真,发生了明显的色调偏移,而暗通道先验算法去雾图像较易产生Halo效应,颜色较重,显得过于饱和。因此,可以得出,其他方法从主观评价的角度来看并不能较好地应用于无人机航拍遥感图像,因为仅从原大气散射模型或图像增强的角度出发,更适合对普通低空户外图像进行去雾,而对无人机遥感图像进行去雾处理,不能得到良好的效果。而本文的方法针对无人机图像的去雾更为科学,且效果更优,没有Halo效应,而且更好地再现了场景的真实颜色。

|

| 图 4 不同方法的去雾效果 Fig. 4 Dehazing results of different methods |

| 图选项 |

本文初步采用标准差、信息熵来定量评价去雾效果。图像的标准差反映了像素点的离散程度。信息熵是图像的平均信息量,从信息论的角度出发,反映了图像信息的多少。评价结果如表 2所示。

表 2 去雾前后的标准差和信息熵 Table 2 Standard deviation and information entropy before and after dehazing

| 序号 | 标准差 | 信息熵 | |||

| 原图 | 去雾后 | 原图 | 去雾后 | ||

| 1 | 21.817 700 | 55.956 15 | 4.114 371 | 5.231 381 | |

| 2 | 23.575 430 | 53.351 33 | 3.709 058 | 4.910 504 | |

| 3 | 9.018 065 | 43.797 79 | 3.350 642 | 5.034 718 | |

| 4 | 6.289 762 | 30.208 87 | 3.024 568 | 4.867 457 | |

| 5 | 16.996 810 | 36.074 45 | 4.505 224 | 5.264 960 | |

| 6 | 10.341 110 | 23.898 56 | 3.451 581 | 4.779 376 | |

| 7 | 18.149 810 | 41.873 90 | 4.587 965 | 5.440 413 | |

表选项

从表 2中可以看出,本文的去雾方法达到了较好的去雾效果。

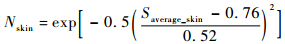

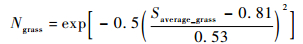

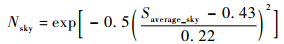

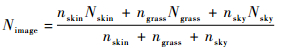

图像色彩自然度,是反映人类视觉判断图像色彩场景是否真实自然的度量,CNI为该判断标准的衡量指标[33-34],其主要用于对去雾后的图像进行评价,取值范围为0~1,一副图像的CNI越接近于1,表明该图像越自然。根据无人机侦察图像的特性,衡量侦察图像的色彩自然度可以起到较好的评价效果。图像色彩自然度的值Nimage的具体计算步骤如下:

1) 将无人机侦察图像从RGB色彩空间转换为CIELUV色彩空间。

2) 计算CIELUV色彩空间中的3个分量,分别为:色调H、饱和度S和亮度L。

3) 对S和L分量分别进行阈值化:S分量保留大于0.1的值,L分量保留20~80这一区间内的值。

4) 依据H值将图像像素分为3类: “skin”像素为25~70,“grass”像素为95~135,“sky”像素为180~260。

5) 针对“skin”、“grass”和“sky”像素分别计算它们的饱和度S均值为:Saverage_skin,Saverage_grass,Saverage_sky。同时分别统计3类像素的数目为nskin、ngrass、nsky。

6) 分别计算3类像素的图像色彩自然度值:

| (18) |

| (19) |

| (20) |

7) 计算最终的图像色彩自然度CNI的值:

| (21) |

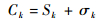

图像色彩丰富度,是反映色彩的鲜艳生动程度的度量,CCI为该判断标准的衡量指标[35-36]。图像色彩丰富度的值Ck由式 (22) 计算得出:

| (22) |

式中:Sk为k图像的饱和度S分量的均值;σk为其标准差。将该指标用来评价去雾后的无人机侦察图像y,当CCI值在某一特定取值区间内时,人类的视觉对图像的色彩感知最为合适。图像色彩丰富度衡量指标与图像内容有关,主要用来衡量相同景物、同一场景、不同去雾效果下色彩的丰富程度。

表 3给出了几幅无人机侦察图像去雾图像的CNI和CCI评价指标的值。从表 3中可以看出,去雾后,图像色彩自然度和图像色彩丰富度均有明显提高,证明本文的去雾方法起到了良好的去雾效果。

表 3 去雾前后的CNI和CCI Table 3 CNI and CCI before and after dehazing

| 序号 | CNI | CCI | |||

| 原图 | 去雾后 | 原图 | 去雾后 | ||

| 1 | 0.458 457 | 0.564 170 | 65.952 55 | 167.536 70 | |

| 2 | 0.545 394 | 0.624 008 | 100.782 20 | 157.108 10 | |

| 3 | 0.463 714 | 0.597 543 | 45.798 24 | 162.026 30 | |

| 4 | 0.450 407 | 0.522 387 | 38.751 14 | 136.424 70 | |

| 5 | 0.435 621 | 0.520 872 | 23.266 67 | 48.885 40 | |

| 6 | 0.422 680 | 0.417 078 | 12.794 68 | 27.341 50 | |

| 7 | 0.468 173 | 0.492 878 | 26.322 86 | 40.960 57 | |

表选项

为了综合评价去雾效果,本文将标准差、信息熵、CNI、CCI 4个指标进行归一化再加和处理,得到一个综合评价指标。最终评价结果如表 4所示。对无人机中低空侦察图像集中的1 000幅图像进行实验。几种方法的综合评价指标的比较如图 5中柱状图所示,红色部分为图像通过不同去雾方法处理后得到的综合评价指标的平均值;蓝色部分为不同去雾方法得到的图像与原图像相比评价指标提升的百分比。本文方法得到的去雾图像的综合评价指标比原图像的综合评价指标平均提升了214.5%,可以看出本文方法取得了良好的去雾效果。

表 4 不同方法的综合评价指标比较 Table 4 Comparison of comprehensive evaluation index among different methods

| 序号 | 原图 (a) | 自适应直方图均衡 (b) | 自适应色阶对比度 (c) | 多尺度Retinex (d) | 均值滤波 (e) | 高斯滤波 (f) | 暗通道先验 (g) | 本文方法 (h) |

| 1 | 1.001 3 | 1.935 004 | 2.522 596 | 2.076 970 | 2.174 849 | 2.384 549 | 2.831 008 | 2.542 759 |

| 2 | 1.096 2 | 2.180 398 | 3.255 074 | 2.170 184 | 1.738 967 | 2.488 135 | 2.566 417 | 2.636 486 |

| 3 | 0.398 5 | 1.167 745 | 1.740 431 | 2.200 087 | 0.486 920 | 1.058 386 | 2.026 381 | 2.268 815 |

| 4 | 0.171 5 | 0.618 922 | 1.463 787 | 2.015 525 | 0.242 398 | 0.994 793 | 2.240 572 | 1.948 523 |

| 5 | 0.931 4 | 1.983 790 | 2.130 797 | 2.185 008 | 1.619 569 | 1.962 495 | 2.030 415 | 2.020 827 |

| 6 | 0.319 6 | 1.073 086 | 1.533 132 | 2.008 388 | 0.676 075 | 0.858 428 | 0.910 497 | 1.157 127 |

| 7 | 1.050 4 | 2.015 479 | 2.038 903 | 2.097 325 | 2.669 215 | 2.004 094 | 2.214 031 | 2.440 271 |

表选项

|

| 图 5 综合评价指标比较 Fig. 5 Comparison of comprehensive evaluation index |

| 图选项 |

本文的方法应用于大量无人机的雾霾图像上,均取得了较好的去雾效果,有效地去除了图像中雾霾的影响,再现了场景对比度和颜色,有助于对无人机侦察图像做一系列后续的处理。

4 结论 本文在图像融合和自动色阶的基础上提出了一种新的基于图像增强的无人机侦察图像去雾算法。经实验验证,得出如下结论:

1) 方法从无人机成像特性出发,针对无人机自身特性,改进了以往的融合算法,对无人机侦察图像的适应性较强。

2) 方法可实现较为优异的去雾性能,去雾后的综合评价指标相比于原图像可提升214.5%,优于其他典型去雾算法。

通过实验分析得到,本文方法的去雾效果较好,很大程度提高了图像的清晰度。未来可以改进该方法,增加该算法的适用性,研究在其他不良环境,如沙尘等天气下的图像清晰化算法。

参考文献

| [1] | FITZGERALD J A S J. An alternative algorithm for adaptive histogram equalization[J].Graphical Models & Image Processing, 1996, 58(2): 180–185. |

| [2] | REZA A M. Realization of the contrast limited adaptive histogram equalization (CLAHE) for real-time image enhancement[J].Journal of VLSI Signal Processing Systems, 2004, 38(1): 35–44.DOI:10.1023/B:VLSI.0000028532.53893.82 |

| [3] | 翟艺书, 刘晓鸣, 涂雅瑗, 等. 一种改进雾天降质图像的清晰化算法[J].大连海事大学学报, 2007, 33(3): 55–58.ZHAI Y S, LIU X M, TU Y Y, et al. An improved fog-degraded image clearness algorithm[J].Journal of Dalian Maritime University, 2007, 33(3): 55–58.(in Chinese) |

| [4] | SEOW M J, ASARI V K. Ratio rule and homomorphic filter for enhancement of digital colour image[J].Neurocomputing, 2006, 69(7-9): 954–958.DOI:10.1016/j.neucom.2005.07.003 |

| [5] | RUSSO R. An image enhancement technique combining sharpening and noise reduction[J].IEEE Transactions on Instrumentation & Measurement, 2002, 51(4): 824–828. |

| [6] | ZHOU J, ZHOU F.Single image dehazing motivated by Retinex theory[C]//2013 2nd International Symposium on Instrumentation and Measurement, Sensor Network and Automation (IMSNA).Piscataway, NJ:IEEE Press, 2013:243-247. |

| [7] | ANSIA S, ASWATHY A L. Single image haze removal using white balancing and saliency map[J].Procedia Computer Science, 2015, 46: 12–19.DOI:10.1016/j.procs.2015.01.042 |

| [8] | SUN Y B, XIAO L, WEI Z H, et al. Method of defogging image of outdoor scenes based on PDE[J].Journal of System Simulation, 2007, 19(16): 3739–3744. |

| [9] | ZHAI Y S, LIU X M, TU Y Y. Contrast enhancement algorithm for fog-degraded image based on fuzzy logic[J].Computer Applications, 2008, 28(3): 662–664.DOI:10.3724/SP.J.1087.2008.00662 |

| [10] | OAKLEY J P. Improving image quality in poor visibility conditions using a physical model for contrast degradation[J].IEEE Transactions on Image Processing, 1998, 7(2): 167–179.DOI:10.1109/83.660994 |

| [11] | NARASIMHAN S G, NAYAR S K.Chromatic framework for vision in bad weather[C]//Proceedings of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition.Piscataway, NJ:IEEE Press, 2002:598-605. |

| [12] | NARASIMHAN S G, NAYAR S K. Vision and the atmosphere[J].International Journal of Computer Vision, 2002, 48(3): 233–254.DOI:10.1023/A:1016328200723 |

| [13] | KOPF J, NEUBERT B, CHEN B, et al. Deep photo:Model-based photograph enhancement and viewing[J].ACM Transactions on Graphics (TOG), 2008, 27(5): 32–39. |

| [14] | TAN R T.Visibility in bad weather from a single image[C]//IEEE Conference on Computer Vision and Pattern Recognition, 2008, CVPR 2008.Piscataway, NJ:IEEE Press, 2008:1-8. |

| [15] | FATTAL R. Single image dehazing[J].ACM Transactions on Graphics (TOG).New York:ACM, 2008, 27(3): 1–9. |

| [16] | HE K, SUN J, TANG X. Single image haze removal using dark channel prior[J].IEEE Transactions on Pattern Analysis and Machine Intelligence, 2011, 33(12): 2341–2353.DOI:10.1109/TPAMI.2010.168 |

| [17] | LIU Q, CHEN M Y, ZHOU D H. Single image haze removal via depth-based contrast stretching transform[J].Science China Information Sciences, 2014, 58(1): 1–17. |

| [18] | WENG C C, CHEN H, FUH C S. A novel automatic white balance method for digital still cameras[J].Images & Recognition, 2006, 4(12): 3801–3804. |

| [19] | KIM J H, JANG W D, SIM J Y, et al. Optimized contrast enhancement for real-time image and video dehazing[J].Journal of Visual Communication & Image Representation, 2013, 24(3): 410–425. |

| [20] | MCCARTNEY E J. Optics of the atmosphere:Scattering by molecules and particles[J].Wiley, 1976, 14(7): 698–699. |

| [21] | PELI E. Contrast in complex images[J].Journal of the Optical Society of America A Optics & Image Science, 1990, 7(10): 2032–2040. |

| [22] | ANCUTI C, ANCUTI C O, HABER T, et al.Enhancing underwater images and videos by fusion[C]//2012 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).Piscataway, NJ:IEEE Press, 2012:81-88. |

| [23] | GUO F, TANG J, CAI Z X. Single image defogging based on fusion strategy[J].Journal on Communications, 2014, 35(7): 199–207. |

| [24] | FANG S, DENG R, CAO Y, et al. Effective single underwater image enhancement by fusion[J].Journal of Computers, 2013, 8(4): 904–911. |

| [25] | ALSABTI K, RANKA S, SINGH V.An efficient k-means clustering algorithm[J/OL]//Electrical Engineering and Computer Science, 1997:43.http://surface.syr.edu/eecs/43. |

| [26] | CHOI D H, JANG I H, MI H K, et al.Color image enhancement using single-scale retinex based on an improved image formation model[C]//6th European Signal Processing Conference, EUSIPCO 2008, 2008:1-5. |

| [27] | QIN X J, WANG H L, DU Y C, et al. Structured light image enhancement algorithm based on retinex in HSV color space[J].Journal of Computer-Aided Design & Computer Graphics, 2013, 25(4): 488–493. |

| [28] | DING J B. Proficient in photoshop CS Chinese version[M].Beijing: Tsinghua University Press, 2004: 55-60. |

| [29] | 刘信. 基于FPGA水下图像像质增强实时化研究[D]. 大连: 大连海事大学, 2013: 10-12.LIU X.The research of underwater image quality real-time enhancenment based on FPGA[D].Dalian:Dalian Maritime University, 2013:10-12(in Chinese). |

| [30] | GUO F, CAI Z X. Objective assessment method for the clearness effect of image defogging algorithm[J].Acta Automatica Sinica, 2012, 38(9): 1410–1419.DOI:10.3724/SP.J.1004.2012.01410 |

| [31] | Image Shop.Image enhancement of local adaptive auto tone/contrast[EB/OL].(2013-10-30)[2015-07-14].http://www.cnblogs.com/Imageshop/p/3395968.html. |

| [32] | LIU Q, CHEN M, ZHOU D.Fast haze removal from a single image[C]//Control and Decision Conference (CCDC).Piscataway, NJ:IEEE Press, 2013:3780-3785. |

| [33] | HANUMANTHARAJU M C, RAVISHANKAR M, RAMESHBABU D R.Natural color image enhancement based on modified multiscale retinex algorithm and performance evaluation using wavelet energy[M]//THAMPI S M, ABRAHAM A, PAL S K.Recent Advances in Intelligent Informatics.Berlin:Springer, 2014:83-92. |

| [34] | YENDRIKHOVSKI S N, BLOMMAERT F J J, DE RIDDER H. Perceptually optimal color reproduction[C]//Proceedings of Human Vision and Electronic Imaging Ⅲ. Bellingham, WA:SPIE, 1998:274-281. |

| [35] | 李青, 郑南宁, 张雪涛, 等. 车载摄像机的一种简易标定方法[J].机器人, 2003, 25(s1): 626–630.LI Q, ZHENG N N, ZHANG X T, et al. A simple calibration approach for camera on-based vehicle[J].Robot, 2003, 25(s1): 626–630.(in Chinese) |

| [36] | JOURLIN M, PINOLI J C. Logarithmic image processing:The mathematical and physical framework for the representation and processing of transmitted images[J].Advances in Imaging and Electron Physics, 2001, 115(1): 129–196. |