1 双边滤波的问题分析1.1 双边滤波法双边滤波法是在高斯滤波法基础上提出的保边滤波法,滤波过程不仅考虑到了空间距离信息,也考虑到了灰度的相似性,但是双边滤波法是局部加权的平均滤波法,所以不可避免地会出现光晕现象.双边滤波法如下:

P为双边滤波后的图像;I为输入图像;ws为距离权重;wr为灰度权重;σs为距离权重的标准差;σr为灰度权重的标准差.

1.2 问题分析双边滤波中灰度标准差σr的取值决定了其距离权重的高斯曲线的扩展程度,σr越大,高斯曲线下降越慢,平滑效果更明显.σr越小,高斯曲线下降越快,平滑效果变弱.因此,如何选取合适的σr是双边滤波保持边缘特性的关键.如果在边缘区域,σr取值过大,会导致边缘部分的模糊,在处理图像时会出现光晕现象,如图 1所示,左侧为图像增强后出现的光晕(halo)效果.而σr取值过小时,虽然保持了边缘区域信息,但无法实现细节和噪声的有效平滑.

|

| 图 1 原图像与出现光晕的图像进行比较Fig. 1 Comparison between original image and image with halo |

| 图选项 |

根据以上问题的分析,本文提出一种基于显著图的保边滤波算法,利用显著性图边缘区域突出的特点以控制该点标准差σr.在边缘区域,σr取较小值;在非边缘区域,σr取较大值,从而更好地实现滤波算法的保边特性,避免传统保边滤波法中的光晕现象.本文算法中假设σr=J(i),在不同区域使得J(i)值不同:较为显著的边缘部分,J(i)≈0,保持边缘清晰.而在非边缘部分,J(i)较大,模糊细节和噪声.式(2)变为如下:

2 基于频率域的显著图显著图是一种模拟生物视觉注意机制的选择性模型,显著图直接反映了图像区域引起视觉注意的强弱程度.显著图是由视觉特殊性以及图像中的颜色、亮度、边缘等特征所决定的,计算机视觉领域利用数学模型模拟了人类视觉的注意力机制,提出了自底向上和自顶向下的显著特征估计算法,显著特性估计目前是自适应压缩[12]、兴趣区域提取[13]、目标检测与识别[14, 15]任务中重要的步骤.根据算法对于效率以及噪声不敏感的要求,本文采用了基于频率域的显著性分析算法[16],此算法比传统的显著图算法保存了更多的高频信息,尤其是边缘部分,如图 2所示.该方法具有的特点:边缘显著;对噪声不敏感;输出完整分辨率的显著图;高效性.

|

| 图 2 突出显著边缘的显著图Fig. 2 Original image and saliency map |

| 图选项 |

本文重点关注的是其突出显著边缘的特点,利用这个特点以简化双边滤波中σr的选取工作.在CIELab颜色空间上进行计算,每个像素取[L,a,b]T向量,首先对图像进行高斯滤波,然后计算其平均灰度向量,并与原图像的高斯滤波结果作差得到每个像素的显著向量,最后计算其显著向量的欧式距离并进行灰度拉伸得到显著图,具体算式如下:

式中,Iu为图像I算术平均灰度向量;IGuass为原始图像高斯模糊后的结果;S(x,y)为图像I的显著值;‖‖为欧式距离.

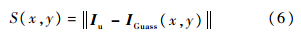

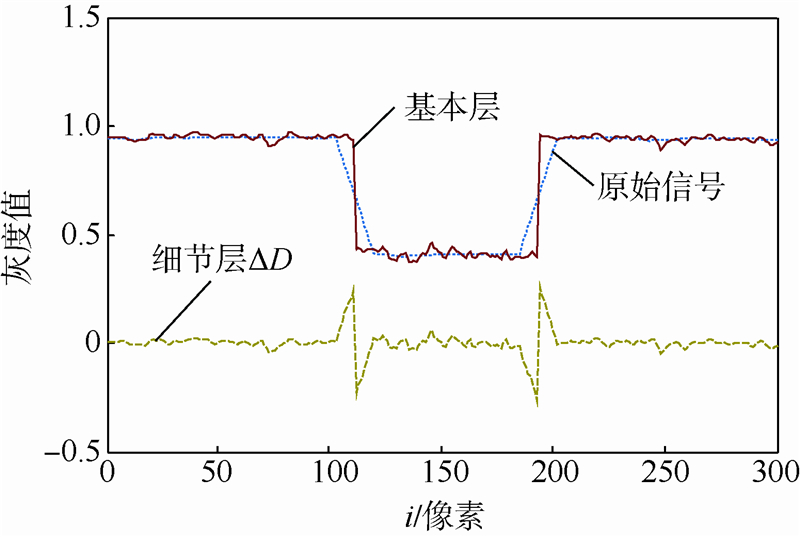

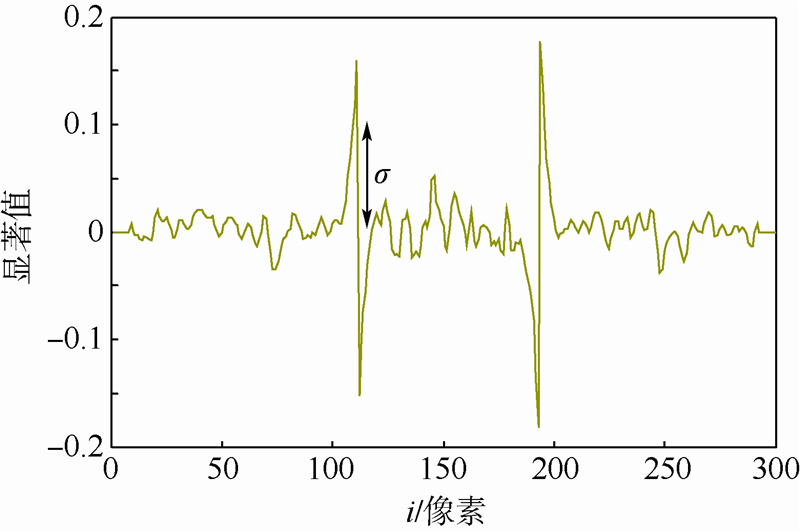

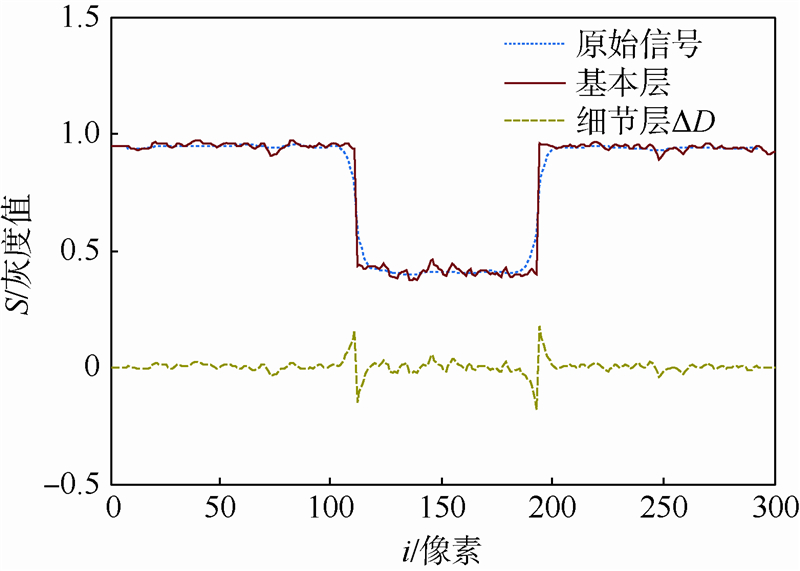

3 阈值分析如图 3所示,将一维信号显著值S通过均值滤波分为两部分:基本层和细节层,图 4是细节层的放大图,细节层包含了噪声和细节高频信息.

|

| 图 3 均值滤波获取的细节层和基本层Fig. 3 Detail layer and base layer by average filtering |

| 图选项 |

将细节层的i位置的灰度值定义为

式中,ΔDi为i位置的高频信息;Si为位置i的显著值;uω为i像素所在窗口均值.本文通过ΔDi来区分边缘区域和非边缘区域,如图 4所示,本文设定阈值σ,认为当ΔDi>σ时i位置像素属于边缘区域,当ΔDi<σ时i位置像素属于非边缘区域.本文取阈值σ=S,S为整个显著图细节层灰度的平均值.

|

| 图 3 均值滤波获取的细节层和基本层Fig. 3 Detail layer and base layer by average filtering |

| 图选项 |

|

| 图 4 细节层ΔD放大Fig. 4 Detail layer ΔD enlarger |

| 图选项 |

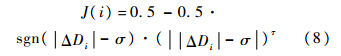

4 自适应灰度因子根据上文分析,本文建立J(i)数学模型:

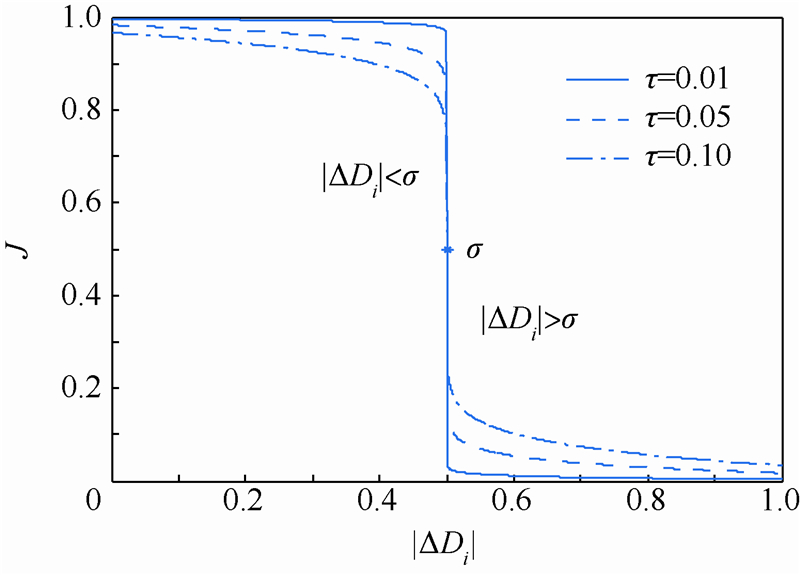

式中,ΔDi=Si-uω;τ为控制曲线陡度的参数,决定图像边缘和非边缘区域阈值处的模糊程度,如图 5所示,当τ=0.01时图像处理较为生硬,而τ=0.1时部分边缘会被模糊.本文经过几组图像的测试,选取τ=0.05,此时图像的边缘保留和细节平滑效果最佳.

|

| 图 5 τ取不同值的模糊结果Fig. 5 Results with different τ |

| 图选项 |

由图 6中曲线可知,当横坐标ΔDi<σ时,进入非边缘区域,随着横轴高频信息ΔDi的减小,J(i)逐渐增大.当ΔDi>σ时进入边缘区域,并且随着高频信息ΔDi增大,J(i)逐渐减小,并趋向于0.

|

| 图 6 不同τ情况下,σ取0.5的J(i)Fig. 6 J(i) with σ=0.5 with different τ |

| 图选项 |

5 保边滤波原理分析针对“边缘区域”,存在ΔDi>σ,此区域内边缘灰度复杂度较高,因此J(i)较小,趋向于0,除了中心像素以外的距离权重因子wr(Ii,Ij)≈0,此时窗口内不做任何处理,保留了此区域信息,实现保边特性.针对“非边缘区域”,此区域包含了噪声细节和平坦部分,复杂度较小,存在ΔDi≤σ,因此J(i)较大,区域内像素的wr(Ii,Ij)≈1,qi退化为高斯滤波结果,实现细节和噪声的有效平滑.

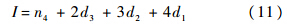

6 一维信号分析由一维信号可见,引导滤波和双边滤波会模糊信号的高频部分,图 7(a)和图 7(b)中在像素索引为100和200左右位置的细节层出现了光晕的环状信息,而图 7(c)中,本文提出的算法在高频处不会出现光晕信息,由此可见本文算法具有较好保边特性.

|

| 图 7 应用于一维信号的3种滤波结果比较Fig. 7 Comparison of the three filtering results of one-dimensional signal |

| 图选项 |

7 实验及其应用7.1 风 格 化图像风格化是计算机图形学中的非真实感绘制的热点问题之一,在图像处理、娱乐、绘画等领域有着较广泛的应用.首先对图像进行多尺度分解,只保留基本层,便可产生抽象的效果,利用Canny算子求出边缘线条,添加到图像中得到风格化效果,如图 8所示.

|

| 图 8 运用本文算法风格化的效果图Fig. 8 Effect drawing of stylization using our method |

| 图选项 |

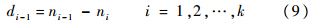

7.2 多尺度图像增强多尺度图像增强,是按照一定的规则把图像分成多个尺度,对不同尺度的细节进行灵活控制,最后结合不同尺度的层次,实现图像质量的有效改善.将输入图像迭代,应用本文滤波算法,得到不同尺度图像ni,随着迭代次数增加,ni平滑程度逐级增大,即越来越多的细节被平滑掉.首先将其分解成为一个光滑的基本层nk和多个细节层d1,d2,…,dk-1:

那么d1,d2,…表示尺度递增的细节层;nk表示基本层.最后将每个细节层各自乘以相应的放大系数,叠加到基本层上,得到最后的增强图像:

式中,I为输出图像;δi为第i层细节层的放大系数.本文实验过程中取k=4,即得到3个细节层d1,d2,d3和一个基本层n4.

实验中与双边滤波法的结果进行比较,如图 9所示,可见本文算法避免了增强过程中光晕现象的出现,并且细节部分增强效果更为明显.

|

| 图 9 多尺度增强Fig. 9 Multi-scale enhancement |

| 图选项 |

7.3 图像降噪将本文算法应用到两幅图片上,并与引导滤波和双边滤波的结果进行比较,从图 10中可见,双边滤波和引导滤波导致边缘部分的模糊,而本文算法则会保持边缘部分清晰.

|

| 图 10 平滑结果Fig. 10 Smoothing results |

| 图选项 |

7.4 HDR色调映射将本文的滤波算法应用于HDR图像的色调映射.图 11显示了本文算法与引导滤波的结果比较,本文算法将图像的亮度进行了有效的压缩,同时保持了原图的细节,避免了光晕的现象.

|

| 图 11 HDR色调映射Fig. 11 HDR Tone-mapping |

| 图选项 |

8 结 论本文提出了基于显著特性的保边滤波算法,利用显著图边缘突出的特点,自适应地进行光滑程度的限制,在显著值较大的地方(边缘区域),双边滤波的灰度标准差较小,不作平滑处理;而显著值较小的地方(非边缘区域),双边滤波的灰度标准差较大,作平滑处理.实验结果表明:1) 本文算法有效地避免了平滑过程中显著边缘周围的光晕现象,抑制噪声的同时保持了图像中显著边缘的部分,与引导滤波以及双边滤波进行比较,本文算法在平滑和多尺度增强方面都更为理想;2) 由于本文算法的保边特性,可以应用于图像细节的分解,在色调映射以及图像风格化等方面也有较好的表现;3) 利用显著图的特点,简化了区分边缘和非边缘的阈值设定工作;4) 本文算法是基于局部平均加权的滤波法,满足并行计算的要求,因此下一步计划在GPU(Graphic Processing Unit)上实现本文算法.

参考文献

| [1] | Gonzalez R C, Woods R E.Digital image processing[M].2nd ed.New York:Prentice Hall,2002:97-98. |

| Click to display the text | |

| [2] | Rudin L I, Osher S,Fatemi E. Nonlinear total variation based noise removal algorithms[J].Physics D:Nonlinear Phenomena,1992,60(1):259-268. |

| Click to display the text | |

| [3] | Xu L, Lu C,Xu Y,et al.Image smoothing via L0 gradient minimization[J].ACM Transactions on Graphics(TOG),2011,30(6): 252-265. |

| Click to display the text | |

| [4] | Farbman Z, Fattal R,Lischinski D,et al.Edge-preserving decompositions for multi-scale tone and detail manipulation[J].ACM Transactions on Graphics(TOG),2008,27(3):67:1-67:10. |

| Click to display the text | |

| [5] | Paris S, Hasinoff S W,Kautz J.Local Laplacian filters:edge-aware image processing with a Laplacian pyramid[J].ACM Transactions on Graphics(TOG),2011,30(4):68:1-68:12. |

| Click to display the text | |

| [6] | Perona P, Malik J.Scale-space and edge detection using anisotropic diffusion[J].Pattern Analysis and Machine Intelligence,1990,12(7):629-639. |

| Click to display the text | |

| [7] | Tomasi C, Manduchi R.Bilateral filtering for gray and color images[C]//Proceedings of the IEEE International Conference on Computer Vision.Piscataway,NJ:IEEE,1998:839-846. |

| Click to display the text | |

| [8] | Porikli F. Constant Time O(1) bilateral filtering[C]//26th IEEE Conference on Computer Vision and Pattern Recognition.Piscataway,NJ:IEEE,2008:1-8. |

| Click to display the text | |

| [9] | Yang Q, Tan K H,Ahuja N.Real-time O(1) bilateral filtering[C]//2009 IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops.Piscataway,NJ:IEEE,2009:557-564. |

| Click to display the text | |

| [10] | Adams A, Gelfand N,Dolson J,et al.Gaussian KD-trees for fast high-dimensional filtering[J].ACM Transactions on Graphics(TOG),2009,28(3):21:1-21:12. |

| Click to display the text | |

| [11] | He K, Sun J,Tang X O.Guided image filtering[C]//Computer Vision-ECCV.Heidelberg:Springer Verlag,2010:1-14. |

| Click to display the text | |

| [12] | Christopoulos C, Skodras A,Ebrahimi T.The JPEG2000 still image coding system:an overview[J].Consumer Electronics,2000,46(4):1103-1127. |

| Click to display the text | |

| [13] | Han J, Ngan K N,Li M,et al.Unsupervised extraction of visual attention objects in color images[J].Circuits and Systems for Video Technology,2006,16(1):141-145. |

| Click to display the text | |

| [14] | Rutishauser U, Walther D,Koch C,et al.Is bottom-up attention useful for object recognition?[C]//Computer Vision and Pattern Recognition,2004.Washington,D.C.:IEEE,2004,2:II-37-II-44. |

| Click to display the text | |

| [15] | 李志成,秦世引, Itti Lauren.遥感图像的显著-概要特征提取与目标检测[J].北京航空航天大学学报,2010(6):659-662. Li Z C,Qin S Y,Itti L.Extraction of saliency-gist features and target detection for remote sensing images[J].Journal of Beijing University of Aeronautics and Astronautics,2010(6):659-662(in Chinese). |

| Cited By in Cnki (423) | |

| [16] | Achanta R, Hemami S,Estrada F,et al.Frequency-tuned salient region detection[C]//2009 IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops.Piscataway,NJ:IEEE,2009:1597-1604. |

| Click to display the text |