针对机器人自适应抓取的需求,有的研究集中于设计柔性更高的末端执行器,如增加欠驱动自由度[1]、使用柔性材料[2]等;有的研究致力于在末端执行器中增加传感器,如增加触觉反馈[3]、改进末端执行器控制[4]等。上述方法能够提高机器人末端执行器的适应能力,但只能在末端执行器的工作范围附近实现自适应抓取。

更多的研究采用视觉获得物体的位姿,调整机器人的运动,实现机器人的自适应抓取。Hoffmann等[5]通过无监督方法训练机器人的手眼协调过程,使机器人能够根据物体的位姿规划自身的运动。Saxena等[6]通过分析目标物体的多个图像,得到目标物体的所在位置和形状,以此为依据产生合适的机器人抓取策略。Lippiello等[7]通过机器人的视觉在虚拟空间中重建目标物体,然后利用设计的规划器调整机器人的运动。

就物体位姿的适应过程来说,上述机器人自适应抓取过程分为2个步骤:① 根据相机获取的视觉信息计算目标物体的空间位姿;② 根据空间位姿规划机器人要到达的关节坐标。为了得到相机中的观测变量到空间位姿的转换关系,需要对机器人的视觉系统进行标定。传统的机器人视觉系统标定方法(如张正友标定法[8]、基于机械臂的在线视觉标定法[9]、基于运动路径靶标的标定法[10]等)对工作人员的专业知识和操作技能有较高的要求,需要花费较多的时间才能完成。

基于视觉伺服[11]的机器人运动控制将机器人控制和视觉结合在一起,不需要视觉系统的标定过程。Siradjuddin等[12]通过视觉伺服实现了7自由度机器人的自适应位置控制;Thomas等[13]利用视觉伺服控制飞行器完成抓取动作和停靠动作。利用视觉伺服能够实现机器人对目标物体位姿的适应,但机器人运动的调整过程需要不断地对图像进行分析和处理,增加了系统工作时的计算负担。

为了提高机器人的操作能力,一种方法是打破传统6自由度机器人4-6轴关节交于一点的约束,如UR公司的UR3机器人、Fanuc的喷涂机器人等;另一种方法是增加机器人的自由度,使机器人具有更高的灵活性,如ABB的Yumi和KUKA的LBR iiwa等。上述机器人的逆运动学解析形式很难得到,基于顺序检索[14]和加权最小范数[15]的求解方法能够求解出符合目标位姿的机器人关节角度,但需要花费较多的时间,不利于机器人的实时控制。限制机器人关节轴的工作范围[16]或者固定机器人的某个关节轴[17],能够得到7自由度机器人逆运动学解析解,但不能充分发挥7自由度机器人的工作能力。

本文提出了一种基于高斯过程的机器人自适应抓取策略。从样本中学习,通过高斯过程使物体的观测变量和机器人关节角度相关联,实现了机器人对目标物体的自适应抓取。本文方法无需机器人视觉系统的标定和机器人运动学求逆,降低了对使用者的专业技能要求,减少了机器人控制过程所需的计算量。

1 机器人的自适应抓取 在执行抓取任务时,机器人需要根据目标物体的位姿,调整自身的运动。机器人对目标物体的自适应抓取模型可以概括为

| (1) |

式中:o为目标物体的观测变量,以下oi与之相同;r为与之对应的关节坐标,以下ri与之相同;f为从目标物体的观测变量到关节坐标的映射函数。

假设X={x1, x2, …, xn}为获得的样本集合,xi=[ri, oi]T为关节变量和观测变量组成的样本向量。机器人的自适应抓取过程在于从样本集合X中学习得到映射函数f,使机器人能够根据观测变量o获得合适的关节坐标r。

选择合适的模型对映射函数f进行描述,对自适应抓取的实现十分重要。神经网络、马尔可夫链等模型需要较多的训练样本,并且难以构建连续变量之间的关联[18]。传统的线性回归方法则不能描述关节坐标与目标物体的笛卡儿空间坐标的非线性关系。

相比之下,高斯过程[19]作为一种贝叶斯学习方法,能够赋予机器人从样本中学习映射函数f的能力,只需要较少的样本就能够完成模型的训练,构建相关变量之间的非线性联系。因此,高斯过程在机器人的技能学习[20]、优化控制[21]和损伤恢复[22]过程中都得到了广泛应用。

2 基于高斯过程建模 基于高斯过程的机器人自适应抓取策略如图 1所示。该策略省去了视觉系统的标定和运动学求逆。在投入使用前需要从样本中学习,获得高斯过程模型的参数。

|

| 图 1 基于高斯过程的自适应抓取 Fig. 1 Adaptive grasping based on Gaussian process |

| 图选项 |

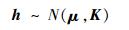

2.1 模型的训练 在未得到任何数据前,假设关节变量和目标物体的观测变量共同构成均值为μ、协方差矩阵为K的高斯分布:

| (2) |

式中:h=[r, o]T为由关节变量和观测变量的真实值构成的向量。通过人工拖动示教编程得到的样本集合X={x1, x2, …, xn}中包含测量噪声,因此有

| (3) |

式中:ε为均值为0、方差为σn2的高斯噪声。包含测量噪声的训练样本为x1, x2, …, xn,对应的真实样本分别为h1, h2, …, hn,并有H={h1, h2, …, hn}代表真实样本构成的集合。

通过样本集合X得到多维变量的后验分布同样为高斯分布:

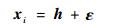

| (4) |

式中:θ=[μ, K, σn2]。

对于样本集合X,其边缘似然函数为

| (5) |

式中:

|

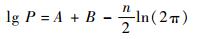

对式(5) 取对数得到

| (6) |

式中:A和B分别为模型的数据拟合项和模型复杂度的惩罚项。

|

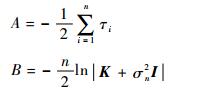

由式(5) 分别对模型的均值向量和协方差矩阵求偏导,并置导数为0,可以得到高斯过程的均值向量和协方差矩阵的极大似然估计分别为

| (7) |

| (8) |

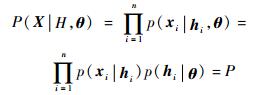

2.2 关节变量的预测 对高斯过程的向量和矩阵进行分块得到

| (9) |

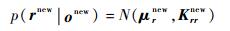

式中:μr为训练样本集合中6个关节变量构成向量的均值;μo为训练样本集合中3个观测变量构成向量的均值;Krr和Koo分别为关节变量之间和观测变量之间的协方差;Kor为观测变量与关节变量的协方差;Kro为关节变量与观测变量的协方差,且有Kro=KorT。机器人从相机中得到目标物体的观测信息onew,对应的关节角度rnew的条件概率分布为

| (10) |

式中:μrnew为与新位姿相匹配的关节角度分布的均值,对应高斯分布的最大概率密度;Krrnew为高斯分布的协方差矩阵,代表了预测结果的不确定性。通过驱动机器人关节到达μrnew,能够使机器人以最大的可能性完成抓取。

|

通过读取控制器的数据,能够得到机器人关节坐标。这里忽略噪声对模型预测不确定性的干扰,取

| (11) |

在不需要进行视觉系统标定和运动学求逆的情况下,高斯过程直接关联了机器人关节变量和目标物体的观测变量,使机器人能够根据新的观测变量预测与之相适应的机器人关节角度。

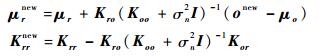

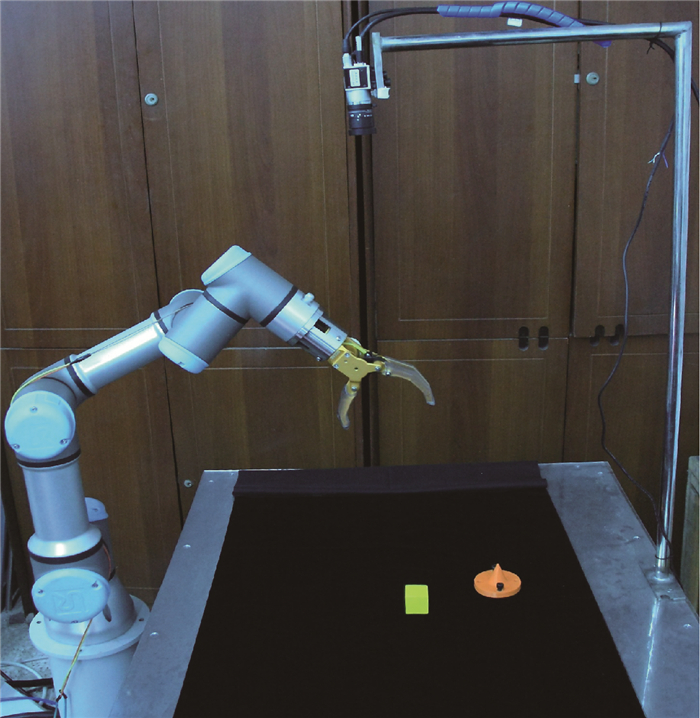

3 实验 3.1 实验配置 整个实验平台如图 2所示,相机布置在机器人工作空间上方,目标物体为桌面上带有颜色的物块,机械臂和末端执行器布置在平台左侧。

|

| 图 2 实验平台 Fig. 2 Experimental platform |

| 图选项 |

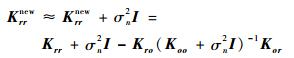

3.1.1 UR3机器人 选取UR3机器人进行自适应抓取实验。如图 3所示,机器人从底部基座到机械臂末端的6个关节轴分别为:基座-肩关节-肘关节-腕关节1-腕关节2-腕关节3。为了实现更高的灵巧性和操作能力,UR3机器人的3个腕部关节并未正交。

|

| 图 3 UR3机器人及其关节轴 Fig. 3 UR3 robot and its joint axis |

| 图选项 |

3.1.2 相机和观测变量 实验选取的相机型号为MV-EM200C/M,相机的分辨率为1 600×1 200。

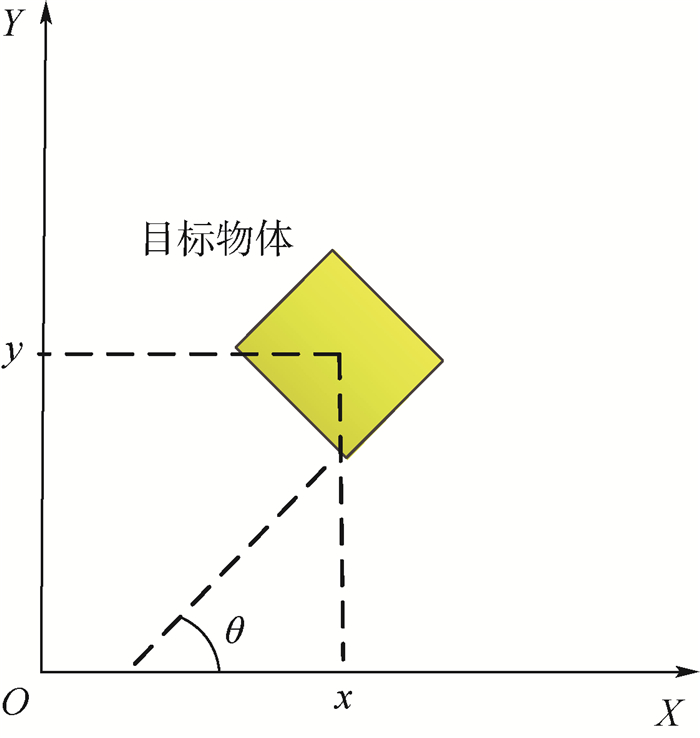

如图 4所示,对检测到的色块边缘点坐标取平均,获取目标物体中心的像素坐标x和y。在此基础上,取四边形的一边用于计算目标物体与相机横坐标轴所成的夹角θ。

|

| 图 4 目标物体的位姿 Fig. 4 Pose of target object |

| 图选项 |

3.1.3 末端执行器 末端执行器为单自由度抓手。如图 5所示,末端执行器包含3根手指结构,通过电机驱动完成抓取动作。

|

| 图 5 末端执行器的结构 Fig. 5 Structure of end effector |

| 图选项 |

3.1.4 实验任务 在不需要进行视觉系统标定和运动学求逆的情况下,利用记录的样本训练高斯过程模型,实现目标物体观测变量o(x,y和θ)和机器人的关节坐标r之间的关联。当获得新的观测变量onew后,利用训练的高斯过程计算机器人要到达的关节坐标rnew,控制机器人运动,实现机器人对目标物体的自适应抓取。

3.2 数据与验证

3.2.1 数据的获取 拖动末端执行器完成抓取动作,记录抓取时目标物体的观测变量和机器人的关节坐标,如图 6所示。

|

| 图 6 人工拖动示教编程 Fig. 6 Manual drag teaching programming |

| 图选项 |

在完成12次抓取任务后,得到的训练样本集合如表 1所示。

表 1 训练数据 Table 1 Training data

| 编号 | 观测变量 | 对应的关节角度/(°) | ||||||||

| x/像素 | y/像素 | θ/(°) | 基座 | 肩关节 | 肘关节 | 腕关节1 | 腕关节2 | 腕关节3 | ||

| 1 | 805 | 647 | 87 | 3.2 | -120.5 | -78.5 | -63.2 | 115.9 | -78.4 | |

| 2 | 964 | 700 | 70 | 14.7 | -121.4 | -80.8 | -50.2 | 107.6 | -62.7 | |

| 3 | 919 | 557 | 80 | 13.0 | -110.5 | -96.2 | -50.2 | 107.6 | -62.7 | |

| 4 | 951 | 632 | 32 | 16.7 | -116.1 | -91.4 | -39.5 | 99.7 | -15.4 | |

| 5 | 895 | 577 | 9 | 19.3 | -112.3 | -95.9 | -39.4 | 89.2 | 7.24 | |

| 6 | 969 | 483 | 12 | 26.5 | -105.3 | -104.6 | -39.4 | 90.0 | 7.7 | |

| 7 | 809 | 516 | 16 | 15.7 | -108.8 | -101.2 | -39.5 | 91.5 | -2.2 | |

| 8 | 873 | 593 | 31 | 18.2 | -111.5 | -102.2 | -28.9 | 91.6 | -12.4 | |

| 9 | 975 | 584 | 52 | 21.87 | -111.2 | -101.6 | -31.1 | 95.9 | -26.1 | |

| 10 | 820 | 711 | 63 | 10.2 | -120.4 | -83.9 | -45.4 | 103.6 | -49.8 | |

| 11 | 1 044 | 655 | 29 | 5.9 | -113.2 | -99.8 | -32.3 | 109.0 | -31.6 | |

| 12 | 803 | 594 | 39 | 5.9 | -113.2 | -99.8 | -32.3 | 109.0 | -31.6 | |

表选项

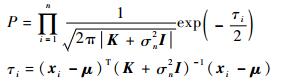

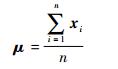

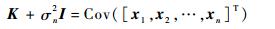

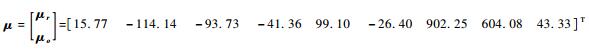

在得到训练样本后,通过式(7) 和式(8) 得到高斯过程均值向量μ和协方差矩阵K+σn2I的极大似然估计。

|

|

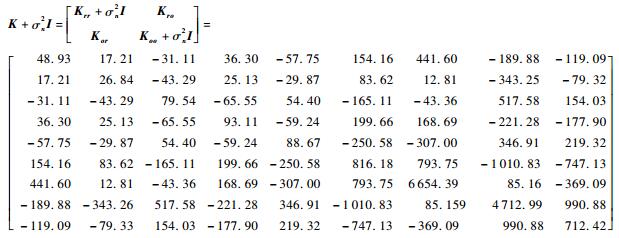

3.2.2 对新目标的自适应抓取 在机器人进行自适应抓取时,首先通过相机得到目标物体的观测变量。

图 7为2个获取目标物体观测变量的过程。

|

| 图 7 目标物体的观测变量 Fig. 7 Observation variables of target object |

| 图选项 |

利用式(10) 计算与目标物体位姿相适应的机器人关节坐标,得到的结果如表 2所示。

表 2 对应图 7中目标物体的关节角度 Table 2 Joint angles corresponding to target objects in Fig. 7

| 编号 | 预测的关节角度/(°) | |||||

| 基座 | 肩关节 | 肘关节 | 腕关节1 | 腕关节2 | 腕关节3 | |

| 1 | 16.3 | -104.4 | -109.1 | -33.9 | 89.9 | 5.4 |

| 2 | 12.6 | -121.3 | -81.5 | -50.7 | 110.3 | -65.5 |

表选项

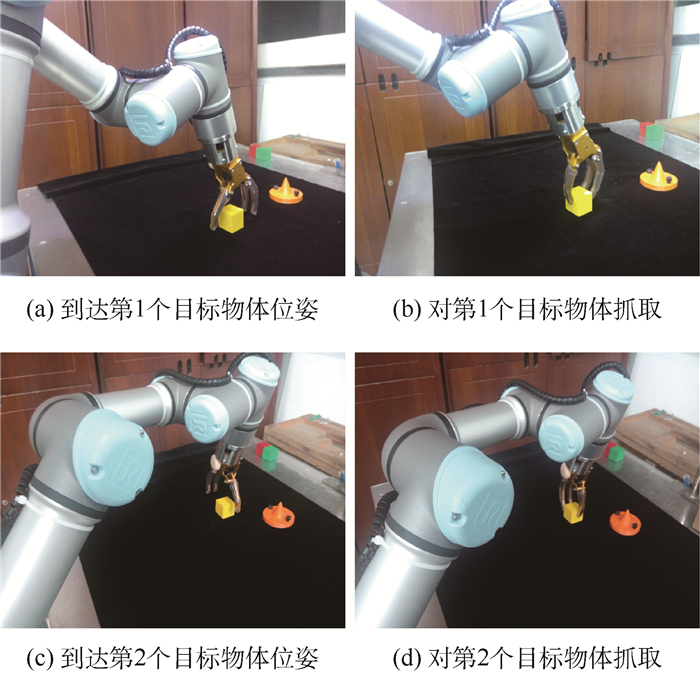

控制机器人运动到对应的关节角度,并驱动末端执行器完成抓取动作,能够实现机器人对目标物体的抓取,如图 8所示。图 8(a)、(b)分别为到达第1个目标物体的位姿和完成抓取动作的过程,图 8(c)、(d)分别为到达第2个目标物体的位姿和完成抓取动作的过程。

|

| 图 8 机器人的自适应抓取 Fig. 8 Adaptive grasping of robot |

| 图选项 |

在此基础上,进行了12次机器人自适应抓取实验,观测变量和预测的机器人关节角度如表 3所示。

表 3 测试样本信息 Table 3 Information of testing samples

| 编号 | 观测变量 | 对应的关节角度/(°) | ||||||||

| x/像素 | y/像素 | θ/(°) | 基座 | 肩关节 | 肘关节 | 腕关节1 | 腕关节2 | 腕关节3 | ||

| 1 | 831 | 630 | 6 | 15.0 | -115.6 | -94.4 | -32.6 | 91.9 | -32.6 | |

| 2 | 966 | 646 | 16 | 21.9 | -116.6 | -92.5 | -33.5 | 90.6 | 5.2 | |

| 3 | 906 | 558 | 28 | 18.5 | -110.7 | -99.3 | -37.7 | 94.0 | -10.5 | |

| 4 | 774 | 472 | 18 | 13.1 | -104.8 | -107.7 | -37.2 | 94.1 | -8.6 | |

| 5 | 712 | 637 | 52 | 2.5 | -117.0 | -89.4 | -45.5 | 108.1 | -47.5 | |

| 6 | 903 | 666 | 30 | 16.1 | -118.3 | -89.2 | -37.6 | 96.7 | -13.1 | |

| 7 | 1 012 | 616 | 54 | 21.1 | -114.9 | -92.0 | -42.7 | 98.6 | -30.2 | |

| 8 | 1 020 | 489 | 77 | 21.4 | -106.2 | -101.7 | -49.1 | 102.2 | -52.5 | |

| 9 | 722 | 429 | 33 | 9.0 | -102.1 | -110.1 | -41.8 | 98.9 | -27.0 | |

| 10 | 649 | 610 | 27 | 1.9 | -114.9 | -93.9 | -40.1 | 103.0 | -26.2 | |

| 11 | 908 | 749 | 51 | 12.6 | -124.4 | -79.8 | -42.4 | 103.6 | -34.2 | |

| 12 | 637 | 780 | 15 | -0.7 | -126.7 | -79.4 | -36.3 | 103.3 | -15.3 | |

表选项

需要注意的是,当目标物体的位置偏离训练样本所在区域较大时,机器人不能完成指定的抓取任务。

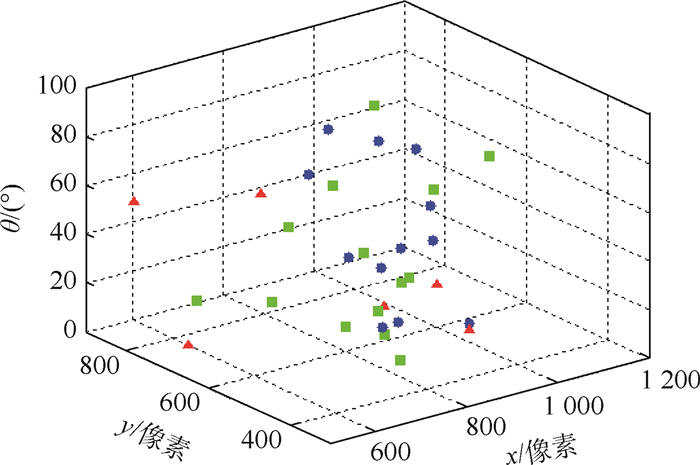

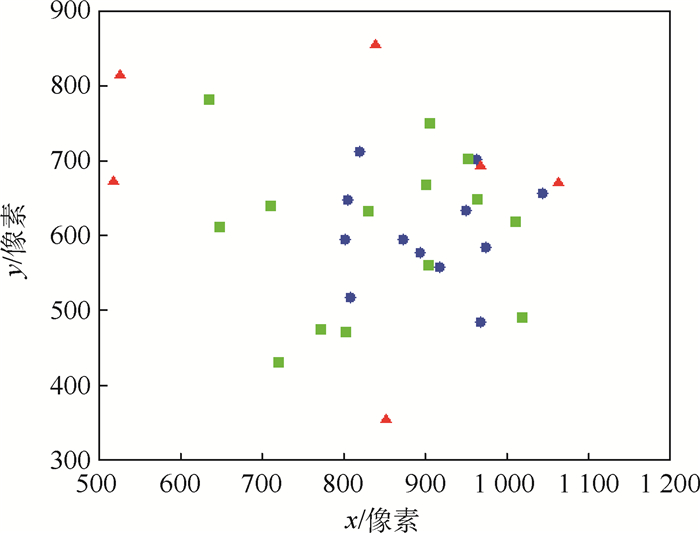

图 9和图 10分别为训练样本和测试样本在三维位姿空间和像素平面中的分布。其中圆形标记的样本点为训练样本,其他标记的样本点为测试样本,正方形标记代表机器人能够成功抓取,三角形标记代表不能成功抓取。当目标物体的位姿在训练样本所构成的空间区域的内部或附近时,机器人能够通过高斯过程得到与目标物体位姿相适应的关节角度,完成自适应抓取过程。但当目标物体的位姿偏离训练样本区域较大时,通过高斯过程模型不能产生合适的关节角度。图 9中不能抓取的测试样本数据在表 4中列出。

|

| 图 9 训练样本和测试样本在三维空间的分布 Fig. 9 Distribution of training and testing samples on 3D space |

| 图选项 |

|

| 图 10 训练样本和测试样本在像素平面上的分布 Fig. 10 Distribution of training and testing samples on pixel plane |

| 图选项 |

表 4 不能抓取的测试样本 Table 4 Testing samples that could not be grasped

| 编号 | 观测变量 | ||

| x/像素 | y/像素 | θ/(°) | |

| 1 | 1 063 | 968 | 9 |

| 2 | 968 | 692 | 3 |

| 3 | 526 | 813 | 59 |

| 4 | 840 | 853 | 43 |

| 5 | 852 | 453 | 25 |

| 6 | 519 | 671 | 11 |

表选项

上述实验结果表明,在训练样本所在区域及其附近,提出的基于高斯过程的机器人自适应抓取策略能够使机器人抓取处于不同位姿的目标物体。

对于机器人的自适应抓取过程来说,能否完成抓取任务取决于机器人末端执行器最终到达的位姿是否合适。在得到模型均值μ和协方差矩阵K+σn2I后,通过高斯过程可以根据指定的机器人关节坐标,预测机器人最终要抓取物体的位置和姿态。

通过训练样本中关节坐标(表 1中的关节坐标样本)预测的目标物体位姿如表 5所示。

表 5 预测的目标物体位姿 Table 5 Predicted pose of target object

| 编号 | 观测变量 | ||

| x/像素 | y/像素 | θ/(°) | |

| 1 | 813 | 653 | 88 |

| 2 | 966 | 701 | 69 |

| 3 | 906 | 547 | 80 |

| 4 | 941 | 629 | 31 |

| 5 | 884 | 569 | 9 |

| 6 | 977 | 485 | 13 |

| 7 | 816 | 524 | 14 |

| 8 | 870 | 589 | 32 |

| 9 | 983 | 593 | 51 |

| 10 | 818 | 709 | 63 |

| 11 | 1 045 | 655 | 29 |

| 12 | 806 | 594 | 39 |

表选项

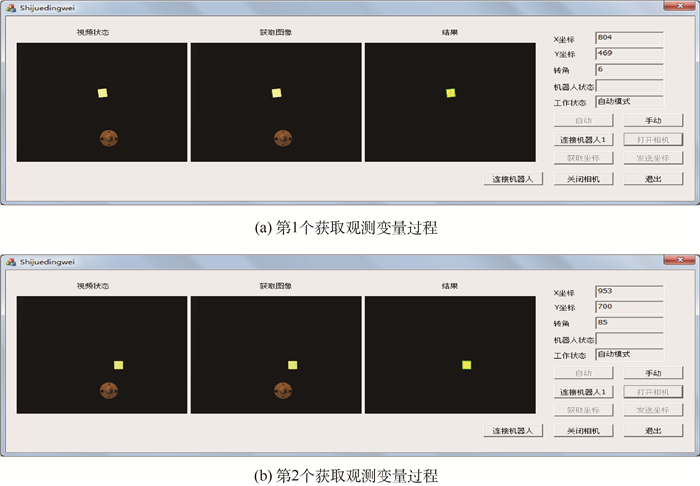

高斯过程属于广义线性回归模型的范畴,其预测精度可以通过计算变量预测值与实际值的平均相对误差来衡量。经计算,本实验中通过高斯过程预测的变量x、变量y和变量θ平均相对误差分别为0.705%、0.487%和0.072%。高斯过程能够较准确地构建机器人关节坐标与目标物体观测位姿的关系,控制机器人运动到预测的关节坐标,能够使机器人末端执行器到达适合抓取的位姿。

本文方法适用于物体的抓取、物体的传递以及人和机器人的交互等场合。

4 结论 1) 本文提出的机器人自适应抓取策略,通过高斯过程直接关联目标物体的观测变量与机器人的关节角度,在不需要机器人视觉系统的标定和运动学逆解的情形下,实现了机器人对目标物体的自适应抓取。

2) 从示教样本中学习,省去了视觉系统的标定,减少了使用者对专业知识的需求。机器人在关节空间的调整过程不需要进行运动学求逆,不需要限制关节轴的运动,能够充分发挥机器人的工作能力。

3) 在确定的场景下,利用较少的训练样本实现了机器人的关节坐标与观测变量的关联,使机器人具备从样本中学习的能力,减少了使用者的编程负担,有利于机器人系统的快速部署并投入应用。

参考文献

| [1] | AHRARY A, LUDENA R D A.A novel approach to design of an under-actuated mechanism for grasping in agriculture application[M]//LEE R.Applied computing and information technology.Berlin:Springer, 2014:31-45. |

| [2] | MANTI M, HASSAN T, PASSETTI G, et al.An under-actuated and adaptable soft robotic gripper[M]//PRESCOTT T J, LEPORA N F, MURA A, et al.Biomimetic and biohybrid systems.Berlin:Springer, 2015:64-74. |

| [3] | BELZILE B, BIRGLEN L. A compliant self-adaptive gripper with proprioceptive haptic feedback[J].Autonomous Robots, 2014, 36(1): 79–91. |

| [4] | PETKOVIC'D, ISSA M, PAVLOVIC'N D, et al. Adaptive neuro fuzzy controller for adaptive compliant robotic gripper[J].Expert Systems with Applications, 2012, 39(18): 13295–13304.DOI:10.1016/j.eswa.2012.05.072 |

| [5] | HOFFMANN H, SCHENCK W, M?LLER R. Learning visuomotor transformations for gaze-control and grasping[J].Biological Cybernetics, 2005, 93(2): 119–130.DOI:10.1007/s00422-005-0575-x |

| [6] | SAXENA A, DRIEMEYER J, NG A Y. Robotic grasping of novel objects using vision[J].International Journal of Robotics Research, 2008, 27(2): 157–173.DOI:10.1177/0278364907087172 |

| [7] | LIPPIELLO V, RUGGIERO F, SICILIANO B, et al. Visual grasp planning for unknown objects using a multifingered robotic hand[J].IEEE/ASME Transactions on Mechatronics, 2013, 18(3): 1050–1059.DOI:10.1109/TMECH.2012.2195500 |

| [8] | ZHANG Z Y. A flexible new technique for camera calibration[J].IEEE Transactions on Pattern Analysis & Machine Intelligence, 2000, 22(11): 1330–1334. |

| [9] | 王一, 刘常杰, 杨学友, 等. 工业机器人视觉测量系统的在线校准技术[J].机器人, 2011, 33(3): 299–302. WANG Y, LIU C J, YANG X Y, et al. Online calibration of visual measurement system based on industrial robot[J].Robot, 2011, 33(3): 299–302.(in Chinese) |

| [10] | 张李俊, 黄学祥, 冯渭春, 等. 基于运动路径靶标的空间机器人视觉标定方法[J].机器人, 2016, 38(2): 193–199. ZHANG L J, HUANG X X, FENG W C, et al. Space robot vision calibration with reference objects from motion trajectories[J].Robot, 2016, 38(2): 193–199.(in Chinese) |

| [11] | CORKE P I. Visual control of robots:High-performance visual serving[M].New York: Wiley, 1997. |

| [12] | SIRADJUDDIN I, BEHERA L, MCGINNITY T M, et al.A position based visual tracking system for a 7 DOF robot manipulator using a kinect camera[C]//International Joint Conference on Neural Networks.Piscataway, NJ:IEEE Press, 2012:1-7.https://www.iitk.ac.in/ee/publications-stream-wise-list |

| [13] | THOMAS J, LOIANNO G, SREENATH K, et al.Toward image based visual servoing for aerial grasping and perching[C]//2014 IEEE International Conference on Robotics and Automation (ICRA).Piscataway, NJ:IEEE Press, 2014:2113-2118. |

| [14] | NIE L, HUANG Q.Inverse kinematics for 6-DOF manipulator by the method of sequential retrieval[C]//Proceedings of the International Conference on Mechanical Engineering and Material Science, 2012:255-258. |

| [15] | CHAN T F, DUBEY R V. A weighted least-norm solution based scheme for avoiding joint limits for redundant joint manipulators[J].IEEE Transactions on Robotics & Automation, 1995, 11(2): 286–292. |

| [16] | SHIMIZU M, KAKUYA H, YOON W K, et al. Analytical inverse kinematic computation for 7-DOF redundant manipulators with joint limits and its application to redundancy resolution[J].IEEE Transactions on Robotics, 2008, 24(5): 1131–1142.DOI:10.1109/TRO.2008.2003266 |

| [17] | LUO R C, LIN T W, TSAI Y H.Analytical inverse kinematic solution for modularized 7-DoF redundant manipulators with offsets at shoulder and wrist[C]//International Conference on Intelligent Robots and Systems.Piscataway, NJ:IEEE Press, 2014:516-521. |

| [18] | EWERTON M, NEUMANN G, LIOUTIKOV R, et al.Learning multiple collaborative tasks with a mixture of interaction primitives[C]//2015 IEEE International Conference on Robotics and Automation (ICRA).Piscataway, NJ:IEEE Press, 2015:1535-1542. |

| [19] | RASMUSSEN C E. Gaussian processes for machine learning[M].Cambridge: MIT Press, 2006. |

| [20] | PARASCHOS A, DANIEL C, PETERS J, et al.Probabilistic movement primitives[C]//Advances in Neural Information Processing Systems(NIPS), 2013:2616-2624. |

| [21] | CALANDRA R, SEYFARTH A, PETERS J, et al.An experimental comparison of Bayesian optimization for bipedal locomotion[C]//IEEE International Conference on Robotics and Automation.Piscataway, NJ:IEEE Press, 2014:1951-1958. |

| [22] | CULLY A, CLUNE J, TARAPORE D, et al. Robots that can adapt like animals[J].Nature, 2015, 521(7553): 503–507.DOI:10.1038/nature14422 |