,1,2, 王婧

,1,2, 王婧 ,1, 王彦棡

,1, 王彦棡 ,1,*

,1,*Turbulence Modeling Based on AutoML

Ren Huiying ,1,2, Wang Jing

,1,2, Wang Jing ,1, Wang Yangang

,1, Wang Yangang ,1,*

,1,*通讯作者: * 王彦棡(E-mail:wangyg@sccas.cn)

收稿日期:2020-03-30网络出版日期:2020-08-20

| 基金资助: |

Received:2020-03-30Online:2020-08-20

作者简介 About authors

任荟颖,中国科学院计算机网络信息中心,在读硕士研究生,主要研究方向为人工智能应用。

本文主要承担工作:实验设计,论文撰写。

Ren Huiying, is a graduate student of the at Computer Network Information Center of Chinese Academy of Sciences. Her main research direction is artificial intelligence application.

In this paper, she is responsible for experiment design and paper writing.

E-mail:

王婧,中国科学院计算机网络信息中心,高级工程师,主要研究方向为人工智能算法应用、多媒体信息检索及大数据分析。

本文主要承担工作:论文撰写。

Wang Jing, M.S., is a senior engineer of Computer Network information Center, Chinese Academy of Sciences. Her research interests include artificial intelligence algorithm application, multimedia information retrieval and big data analysis.

In this paper, she is responsible for paper writing.

E-mail:

王彦棡,中国科学院计算机网络信息中心,博士,研究员,主要研究方向为人工智能应用,高性能计算。

本文主要承担工作:科学问题凝结,把握论文总体结构。

Wang Yangang, PHD, is a research fellow at Computer Network Information Center of Chinese Academy of Sciences. His main research directions are artificial intelligence application and high-performance computing.

In this paper, he is responsible for condensing scientific problems and grasping the overall structure of the paper.

E-mail:

摘要

【背景】 湍流问题涉及到工程中的诸多领域,其重要性不言而喻。雷诺平均Navier-Stokes(RANS)方程提供了一种计算时间平均湍流量的有效方法,由于其计算易处理性而被广泛使用。随着深度学习技术的发展,采用数据驱动的方法建模RANS模型受到了研究者广泛的关注。【方法】本文提出了一种数据驱动建模RANS模型的方法,该方法以数值软件模拟结果为基础,利用深度学习技术构造湍流模型。由于在湍流问题中,不同的系统初始条件不同,数据的质量千差万别,难以使用统一的神经网络结构进行训练。因此本文采用AutoML(自动机器学习)的方法自动搜索神经网络的结构并进行自动调参。此外,本文发现通过混合多种初始条件下的数据进行模型训练,可以提高深度学习模型的拟合精度,增强其鲁棒性。【结果】本文选取OpenFOAM中的经典算例内壁台阶流模拟作为数据来源进行实验。实验表明,该模型在预测雷诺应力时具有较好的精度和效率,表明数据驱动方法在湍流模拟中具有良好的应用前景。【局限】为了更好的在湍流领域应用深度学习技术,下一步的研究重点在于如何将深度学习模型与湍流数值模拟软件耦合。【结论】目前,针对湍流机器学习的系统研究相对较少。在现有工作经验的基础上,机器学习在未来的湍流模型化中必将扮演着更加重要的角色。

关键词:

Abstract

[Background] The turbulence problem involves many fields in engineering, and its importance is self-evident. The Reynolds Average Navier-Stokes (RANS) equation provides an effective method for calculating the time-averaged turbulence, and it is widely used because of its ease in calculation. With the development of deep learning technology, data-driven modeling of RANS model has been widely concerned by researchers. [Methods] In this paper, a data-driven method for modeling RANS is proposed. Based on the results of numerical simulation software, the method uses deep learning technology to construct turbulence models. Because of the different initial conditions of different turbulence systems and various qualities of data, it is difficult to use a unified neural network structures for training. Therefore, we used the method of AutoML (automatic machine learning) in deep learning to solve the problem, which can automatically build appropriate network structures and choose proper hyper-parameters for different datasets. In addition, this paper also improves the method by mixing the data under various initial conditions to train the deep learning model, which greatly increases accuracy and the robustness of our model. [Results] In this paper, a typical example in OpenFOAM about the step flow simulation of the inner wall is selected as the data source for the experiment. The experimental results show that the model has good accuracy and efficiency in prediction of Reynolds stress, which indicates that the data-driven method has a great application prospect in turbulence simulation. [Limitations] In order to better apply deep learning technology in the field of turbulence modeling, the most important issue needs to be solved in the next step is how to couple deep learning models with turbulence numerical simulation software. [Conclusions] At present, there are few systematic researches about turbulence machine learning. Based on the current work, machine learning will play a more important role in the future turbulence modeling researches.

Keywords:

PDF (7871KB)元数据多维度评价相关文章导出EndNote|Ris|Bibtex收藏本文

本文引用格式

任荟颖, 王婧, 王彦棡. 基于AutoML的湍流建模. 数据与计算发展前沿[J], 2020, 2(4): 121-131 doi:10.11871/jfdc.issn.2096-742X.2020.04.010

Ren Huiying, Wang Jing, Wang Yangang.

开放科学标识码(OSID)

引言

在过去的十年中,随着计算机硬件的不断发展,CFD(Computational Fluid Dynamics)已经成为用于流体分析的更主要的工具。目前,对复杂流体力学系统进行建模主要有两种途径。第一种是基于理论的模型架构,即根据物理问题的控制方程,建立理想的系统描述;第二种则是目前比较流行的数据驱动方法[1,2],即根据系统仿真或试验中的样本数据,直接构造黑箱或灰箱模型。近年来,随着计算机性能和精细化流动测试手段的发展,研究者能够获得高精度、高时空分辨率的流场信息。如何高效地利用这些大数据,从中提取出关键信息,并指导流体力学的发展,已经成为研究者关注的焦点。作为处理和分析数据的主要手段,数据挖掘、统计学习和机器学习等技术,则为开展此类研究提供了重要基础[3]。雷诺时均Navier-Stokes(RANS)方程[4]提供了一种计算时间平均湍流量的有效方法,由于其计算易处理性而被广泛使用。目前,RANS模型在实际生产和工程中仍占有重要地位。而在RANS计算的过程中,能否准确求解雷诺应力至关重要。近些年来,人们开始关注使用机器学习和深度方法来求解RANS方程。Tracey等人[5]使用核回归来模拟雷诺应力各向异性特征值。该方法被证明在大量训练数据上的应用效果较差。Tracey,Duraisamy和Alonso[6]后来使用具有单个隐藏层的神经网络来模拟Spalart Allmaras模型中的源项。实验证明这些神经网络能够重建这些源项。 Ma,Lu和Tryggvason[7]使用神经网络代替流体闭合方程来模拟等温气泡流。Zhang和Duraisamy[8]使用神经网络来预测湍流产生项的修正因子。该修正因子会影响预测的雷诺应力张量的幅度但不影响其各向异性。 Ling J,Ruiz A和Lacaze G[9]等人提出使用随机森林来预测雷诺应力各向异性。该方法被证明不能轻易地对张量数量强制执行伽利略不变性,因此在预测完全各向异性张量方面的能力有限。Ling J,Kurzawski A和Templeton J[10]提出一种新的深度神经网络结构从高保真仿真数据中学习雷诺应力各向异性张量,并且他们展示了基于深度学习的雷诺应力对不同几何形状的流动的预测能力。这种方法被证明对DNS仿真效果不好,并且只针对于定常流动。Kutz[11]解决了基于DL的闭合方程应用的几个开放性挑战,解决了应该选择怎样的训练数据的问题。Chang和Dinh[12]分析了五种类型的机器学习框架,讨论了如何耦合机器学习框架和流体模拟的问题。Chang和Dinh[13]后来采用了深度学习的方法来拟合雷诺应力。这种方法被证明对于非定常流动的效果拟合较差,无法拟合出精确的流场效果。

近些年来,自动机器学习技术(Auto Machine Learning,AutoML)有了长足的突破和发展。在深度学习领域,自动机器学习技术包含自动调节超参数[14,15](例如学习率)、自动调整网络结构[16,17](例如神经元的个数,层数等),在深度学习领域取得了不错的成绩。由于在湍流问题中,不同的系统初始条件不同,数据的质量千差万别,难以使用统一的神经网络进行训练。因此用深度学习中AutoML的方法进行拟合,针对不同的数据集自动选取不同的网络结构和参数。此外本文还通过混合多种初始条件下的数据进行模型的训练来提高拟合的精度和模型的鲁棒性。实验表明,拟合效果较之前的方法有了较大程度的提升。

1 相关理论及方法

1.1 AutoML贝叶斯优化理论

机器学习中,调参和搜索网络结构被认为是一项繁琐且耗费人力的工作。手动调参十分耗时,参数的好坏影响网络的性能。 网格和随机搜索需要很长的运行时间,因此诞生了很多自动调参的方法。 长期以来,高斯过程一直被认为是一种针对模型的建模损失函数的好方法[18]。高斯过程(GPs[19])具体描述为建立目标函数的概率模型,用它来选择效果最好的超参数,在真实的目标函数中进行评价。超参数优化的过程可以描述为:

这里$f(x)$表示在验证集上评估得出的最低损失函数的值(例如,RMSE或错误率); ${{x}^{*}}$是产生该最低值的超参数集,并且$x$可以在超参数域$\chi $中取任意值。简单来说,我们想找到在验证集度量标准上产生最佳分数的超参数集合。

高斯过程通过观察过去的评估结果,计算超参数映射到目标函数得分概率的概率模型:

此函数被称为目标函数的“代理”。高斯过程方法通过选择最有潜力的超参数组,通过目标函数进行评估,再带入到高斯过程模型中,进而选择下一组超参数,反复迭代。

具体的算法过程可以描述如下:

(1)建立高斯函数模型$M$,假设损失函数$f$的输出值$y$与超参数$x$之间的关系服从$M$;

(2)从$M$中采集下一组函数值较高的参数${{x}_{t+1}}$;

(3)将${{x}_{t+1}}$带入到损失函数$f$并计算出分数${{y}_{t+1}}$;

(4)将${{x}_{t+1}}$和${{y}_{t+1}}$更新到$M$中;

(5)重复步骤(1)到(4)直到满足停止条件。

贝叶斯优化方法在理论上是有效的,因为它以有根据的方式选择了下一个超参数。它的基本思想是:花更多的时间选择下一个超参数,以减少对目标函数的调用。实际上,与在目标函数中评估花费的时间相比,选择下一个超参数所花费的时间是很少甚至无关紧要的。通过评估,从过去的结果选取出看似更有希望的超参数,贝叶斯方法可以在更少的迭代中找到比随机搜索更好的模型参数设置。

1.2 深度学习在湍流模拟中的应用方法

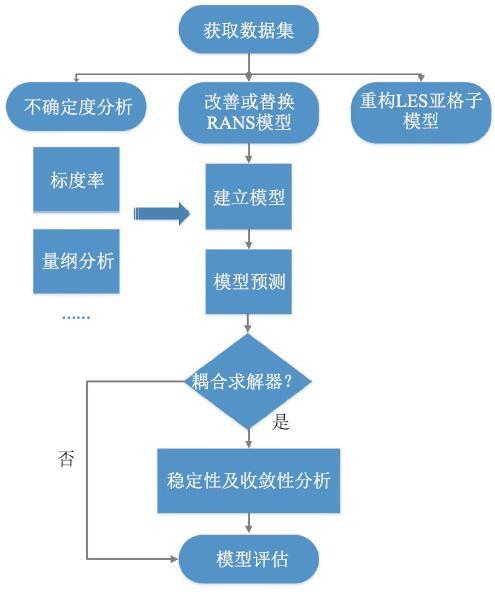

机器学习与湍流建模相结合的研究工作是流体力学领域新兴的热门研究方向。现有的研究成果有力地验证了其有效性和可行性,预示了机器学习在未来湍流模型应用中良好的应用前景[20]。一方面,这些研究工作以数值模拟器或实验产生的高分辨率的数据作为驱动,一定程度上降低了机器学习模型封闭或湍流模型相关变量模型化的难度,证实了纯数据驱动的机器学习黑箱模型在湍流研究应用中的有效性和可行性。另一方面,一些研究者还将机器学习用于描述和量化传统模型计算结果的不确定度,对未来的建模工作具有很好的指导作用[21]。主要的研究方向和建模流程归结为图1所示。图1

新窗口打开|下载原图ZIP|生成PPT

新窗口打开|下载原图ZIP|生成PPT图1机器学习应用于湍流研究的主要研究方向及流程

Fig.1Main research direction and process of machine learning applied to turbulence study

2 本文方法

2.1 RANS-DL 模型

我们假设深度学习可以从不同流场区域中采集的速度场中发现隐藏的时间导数[13]。因此,我们可以从各种模拟时间步骤中采样数据,并使用总数据训练神经网络。因为深度学习属于监督学习方法,需要输入和输出来训练模型。因此,对于深度学习湍流模型,输入应该是能表示平均流动特性的流动特征,目标为雷诺应力六个分量。我们基于RANS方程[22]选择输入的流动特征。RANS方程推导输入输出的过程如下所示:这里$\bar{u}$是平均速度,$i$,$j$,$k$是方向,$\rho $,$\bar{p}$,${{\tau }_{ij}}$,$\mu $和${{\delta }_{ij}}$分别为流体密度,平均压力,雷诺应力分量,粘性系数和Kronecker delta函数。基于我们的假设,每个数据集的数据稳定,因此不选择时间导数作为训练输入。而压力是从动量方程中单独求解的,因此我们进一步发现压力项可以从训练输入中排除。因此基于深度学习的湍流模型的输入可以通过速度的空间导数来表示。使用矩阵形式显示雷诺应力与导数算子、速度的之间的二元乘积,具有的函数关系如公式(6)所示:

由于DNN能够较好的解决回归问题,我们使用DNN来回归拟合替雷诺应力。损失函数采用欧几里德损失函数,其中,$N$,${{y}_{i,\bmod el}}$和${{y}_{i,data}}$分别为训练数据的总数,${{i}^{th}}$训练结果和${{i}^{th}}$雷诺应力值,如公式(7)所示:

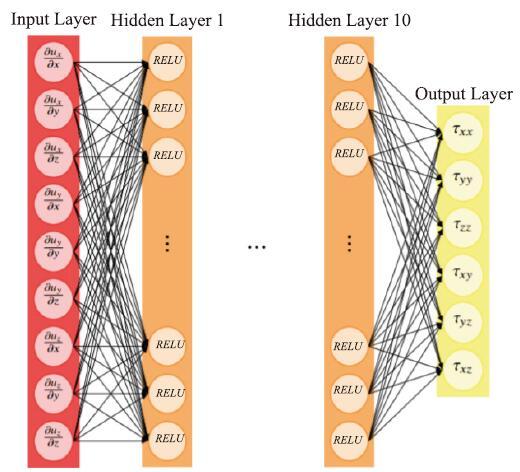

图2为模型的具体形式,只采用每个点的9个速度导数作为输入流特征,目标是它的六个雷诺应力分量。

图2

新窗口打开|下载原图ZIP|生成PPT

新窗口打开|下载原图ZIP|生成PPT图2RANS-DL模型

Fig.2RANS-DL model

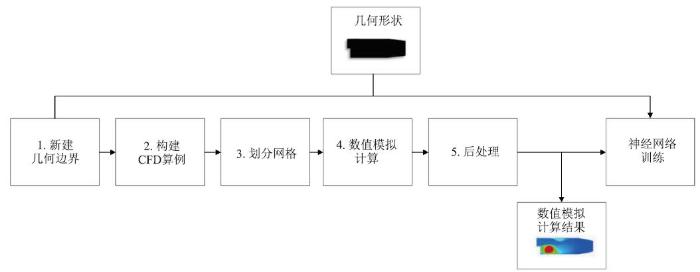

2.2 RANS-DL工作流程

我们假设闭包关系可以从守恒方程实验数据和数据驱动的机器学习模型中分别导出。如图3所示,RANS-DL工作流具体描述如下:(1)首先定义了某一问题的物理几何边界,如模拟结构和系统特性;

(2)利用该几何边界构造了CFD计算实例,包括初始条件、边界条件等;

(3) CFD求解器执行模拟;

(4)从模拟中提取和处理相关数据;

(5)使用这些处理后的数据来训练神经网络。

图3

新窗口打开|下载原图ZIP|生成PPT

新窗口打开|下载原图ZIP|生成PPT图3RANS-DL 工作流程

Fig.3RANS-DL workflow

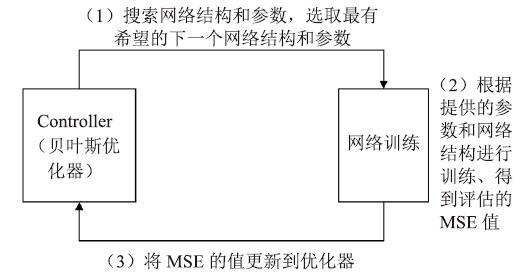

2.3 RANS-AutoML 模型

本文采用了基于AutoML的技术,能够根据不同的初始条件的数据集自动设计网络结构以及调整参数。本文采取贝叶斯优化器负责自动构建网络模型结构(例如RANS-DL模型中隐藏层的节点数,隐藏层的层数),以及自动搜索模型的参数(例如RANS-DL模型中的学习率,学习率衰减指数以及L2正则系数)。 贝叶斯优化器需要先用随机搜索训练n个网络,观察n个网络的性能,从这些过去的经验中更新优化器。主要流程和思想如图4所示。具体的流程如下:

(1)利用随机搜索获得n个网络结构和MSE;

(2)从旧的模型结构,参数以及MSE值生成下一轮需要搜索的模型结构和参数用于模型训练;

(3)模型训练,在验证集上验证产生MSE值;

(4)将本轮的模型结构和参数以及得到的MSE的值再反馈到贝叶斯优化器中;

(5) 重复步骤(1)~(4)直到达到搜索时间或者搜索网络结构得到的MSE值达到预期,便结束得到最优网络的结构及参数。

图4

新窗口打开|下载原图ZIP|生成PPT

新窗口打开|下载原图ZIP|生成PPT图4AutoML 工作流程

Fig.4AutoML workflow

3 实验设置

3.1 数值实验

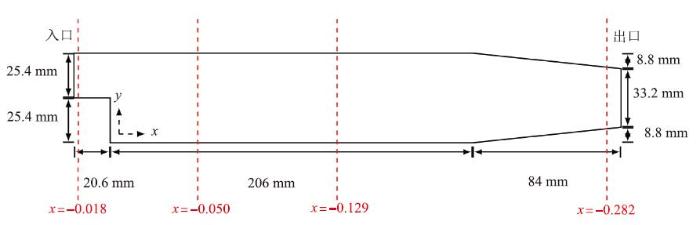

进行数值实验来产生深度学习模拟雷诺应力需要的数据。采用k-$\varepsilon $模型求解RANS模拟得到参考解,用于模型的训练。图5描绘了Pitz和Daily[23]提出的内壁形状,这是一个2D的几何形状,包括一个向后的台阶和一个喷嘴。系统特性总结在表1中。由于不稳定的流动受到湍流混合层、剪切速率等的影响,因此这种几何形状足够复杂。对于这种几何形状,k-$\varepsilon $模型已被验证是可行的[24]。我们用OpenFOAM[25]中的pimpleFoam求解器用于生成数据。图5

新窗口打开|下载原图ZIP|生成PPT

新窗口打开|下载原图ZIP|生成PPT图5数值模拟实验信息

Fig.5Experimental information of numerical simulation

Table 1

表1

表1系统边界信息

Table 1

| 初始条件 | |

|---|---|

| 速度 | 0m/s |

| 压强 | 0bar |

| 边界条件 | |

| 入口速度 | (10,0,0)m/s |

| 入口压强 | 0 |

| 出口流速 | 0 |

| 出口压强 | 0bar |

| 传递性质 | |

| 层流粘性系数 | 10-5 m2/s |

新窗口打开|下载CSV

使用k-$\varepsilon $模型通过RANS仿真生成训练数据。 采用pimpleFoam求解方程,固定时间步长5×10-3秒。为了观察不同的系统初始条件对实验结果的影响,我们设计了8个数据集,并在表2中列出。设计实验如下:

(1)采用A1、A2、A3分别训练,并在验证集B上验证观察实验结果,观测对训练数据进行时间和空间的加密对测试结果有无影响;

(2)采用A1、A4、A5/A1、A6、A7分别/混合训练,并在验证集B上验证观察实验结果,观测改变训练数据的入口流速/层流粘性系数对测试结果有无影响;

(3)采用A1、A6、A7分别/混合训练,并在验证集B上验证观察实验结果,观测改变训练数据的层流粘性系数对测试结果有无影响。

Table 2

表2

表2数据集信息

Table 2

| 数据集 | 网格大小 | 流速 | 层流粘性系数 | 数据集大小 | 备注 |

|---|---|---|---|---|---|

| 训练集A1 | 114700 | 10m/s | 1.0e-5 | 1147000 | 时间窗口[0.01,0.1],均匀采样十次 |

| 训练集A2 | 28675 | 10m/s | 1.0e-5 | 1147000 | 时间窗口[0.01,0.1],均匀采样四十次 |

| 训练集A3 | 458800 | 10m/s | 1.0e-5 | 4588000 | 时间窗口[0.01,0.1],均匀采样十次 |

| 训练集A4 | 114700 | 5m/s | 1.0e-5 | 1147000 | 时间窗口[0.01,0.1],均匀采样十次 |

| 训练集A5 | 114700 | 20m/s | 1.0e-5 | 1147000 | 时间窗口[0.01,0.1],均匀采样十次 |

| 训练集A6 | 114700 | 10m/s | 0.5e-5 | 1147000 | 时间窗口[0.01,0.1],均匀采样十次 |

| 训练集A7 | 114700 | 10m/s | 2.0e-5 | 1147000 | 时间窗口[0.01,0.1],均匀采样十次 |

| 验证集B | 114700 | 10m/s | 1.0e-5 | 1147000 | 时间窗口[0.01,0.91],均匀采样十次 |

新窗口打开|下载CSV

3.2 基于AutoML的雷诺平均湍流模型求解模型

我们使用Tensorflow[26]来设计DNN结构,激活函数采用ReLU[27],并且在每个隐藏层采用BN[28]。 模型采用Adam[29]算法作为深度学习的优化算法来更新模型的参数,例如权重w和偏差b等。模型的网络结果和具体参数,包含:网络的层数,每层隐藏单元的个数、学习率、L2正则系数均用前文介绍的贝叶斯优化方法进行搜索。4 实验结果及分析

为了更好的展示实验的结果,如图5所示,我们选取了验证集上流场的不同区域来观察模型训练的效果。这些区域包含入口,台阶流,流场中较为平缓的区域以及出口处的区域,比较能代表流场的情况,从而反应出模型训练的效果。4.1 AutoML实验结果

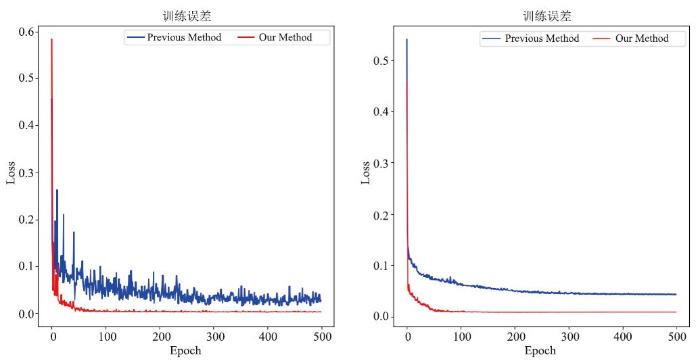

网络结构搜索以及参数调整的小时数为48小时,本文做实验的机器配置:CPU 为双核4线程, GPU为Tesla V100。最终AutoML的训练效果如图6所示。经过训练,本文最终采用的模型参数如表3所示。图6

新窗口打开|下载原图ZIP|生成PPT

新窗口打开|下载原图ZIP|生成PPT图6AutoML的效果

Fig.6Effect of AutoML model

Table 3

表3

表3模型参数

Table 3

| 参数名称 | 详情 |

|---|---|

| 隐藏层数 | 17 |

| 隐藏单元数 | 512 |

| 学习率 | 0.02993 |

| 学习率衰减指数 | 0.41701 |

| L2正则系数 | 0.06730 |

新窗口打开|下载CSV

如图7所示,与Chang和Dinh [10]采用的神经网络结构来拟合雷诺应力的效果对比,我们用AutoML获得的网络结构拟合效果更为优异。

图7

新窗口打开|下载原图ZIP|生成PPT

新窗口打开|下载原图ZIP|生成PPT图7AutoML的网络结构与之前方法的对比

Fig.7Comparison between AutoML network structure and previous methods

4.2 时间信息对模型的影响

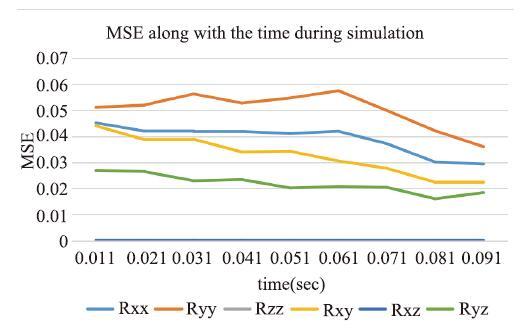

我们假设深度学习可以从不同流场区域中采集的速度场中发现隐藏的时间导数,因此需要验证训练好的模型能否重建验证集上的不同时刻的雷诺应力的参考解。 如图8所示,在模拟过程中,每个雷诺应力张量分量的MSE随时间保持稳定。因此可以得出结论,DNN模型可以学习到流场数据中隐含的时间导数信息。图8

新窗口打开|下载原图ZIP|生成PPT

新窗口打开|下载原图ZIP|生成PPT图8雷诺应力张量分量随时间变化拟合效果

Fig.8MSE along with the time during simulation

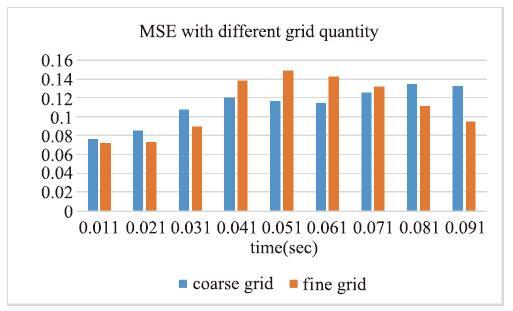

4.3 网格疏密对模型的影响

为了检验数值实验中网格的疏密对深度学习网络模型的训练效果有无影响,我们将模型分别以四倍的网格差在不同疏密程度的数据上进行训练,同时为了降低数据规模变化对模型训练造成的影响,将稀疏网格的数据在时间采样上加密了四倍,在验证集上进行验证。如图9所示,从粗网格生成的训练数据的训练结果与从细网格生成的数据训练结果几乎相同。图9

新窗口打开|下载原图ZIP|生成PPT

新窗口打开|下载原图ZIP|生成PPT图9不同疏密网格数据训练模型的效果

Fig.9MSE with different grid quantity

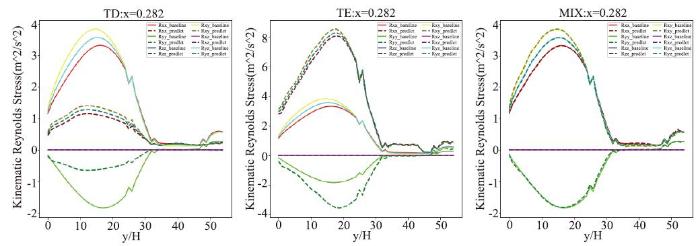

4.4 扰动入口流速对模型的影响

为了检验入口流速的改变是否会对模型的训练结果造成影响,将模型分别在入口流速为5m/s、20m/s以及混合多种流速的情况下进行训练,并在验证集上进行验证。如图10所示,模型在较小的入口流速下训练模型,会倾向于预测较小的结果;模型在较大的入口流速下训练模型,预测的结果也会偏大;而在混合入口流速下,训练的效果更好,模型的鲁棒性也更好。图10

新窗口打开|下载原图ZIP|生成PPT

新窗口打开|下载原图ZIP|生成PPT图10不同入口流速下数据训练模型的效果

Fig.10The effect of data training model under different inlet velocity

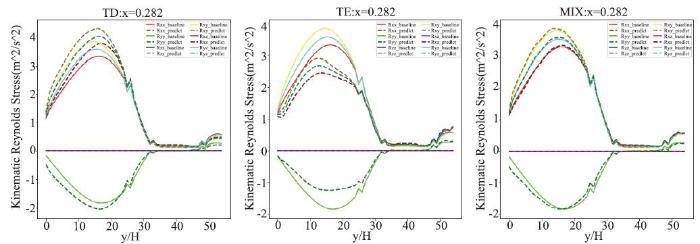

4.5 扰动层流粘性系数对模型的影响

为了检验层流粘性系数的改变是否会对模型的训练结果造成影响,将模型分别在层流粘性系数为 0.5e-5m/s、1e-5m/s、2e-5m/s以及混合多种层流粘性系数的情况下进行训练,并在验证集上进行验证。如图11所示,模型在较小的层流粘性系数下训练模型,会倾向于预测较大的结果;模型在较大的层流粘性系数下训练模型,预测的结果会偏小;而在混合层流粘性系数下,训练的效果更好,模型的鲁棒性也更好。图11

新窗口打开|下载原图ZIP|生成PPT

新窗口打开|下载原图ZIP|生成PPT图11不同层流粘性系数下数据训练模型的效果

Fig.11The effect of data training model under different laminar viscosity coefficient

5 结论与展望

本文提出了一种用AutoML方法建模RANS模型的方法,该方法使用AutoML方法来再现RANS(k-ε)数值模拟的解。通过实验结果的分析, 可以看出基于 AutoML 的方法能够自动构建网络结构和调整参数, 在保证准确率的情况下减少人力的工作。另外,本文还发现了一些有意义的结论:速度场的一阶空间导数的流动特征对于重建RANS结果是必要且充分的,模型能学到流场数据中隐含的时间导数信息;另外,在混合入口流速、层流粘性系数的数据上训练,能使得模型的鲁棒性更好. 目前,系统的针对湍流机器学习的特征选取的研究还相对较少。在现有工作积累的经验基础上,机器学习在未来的湍流模型化中必将扮演着更加重要的角色。利益冲突声明

所有作者声明不存在利益冲突关系。参考文献 原文顺序

文献年度倒序

文中引用次数倒序

被引期刊影响因子

[J].

[本文引用: 1]

[J].

[本文引用: 1]

[J].

[本文引用: 1]

[本文引用: 1]

[本文引用: 1]

[本文引用: 1]

[J].

DOI:10.1063/1.4930004URL [本文引用: 1]

[本文引用: 1]

[J].

[本文引用: 1]

[J].

[本文引用: 2]

[J].

DOI:10.1017/jfm.2016.803URL [本文引用: 1]

[J].

DOI:10.1016/j.ijthermalsci.2018.09.002URL [本文引用: 1]

[J].

[本文引用: 2]

[J].

[本文引用: 1]

[本文引用: 1]

[C].

[本文引用: 1]

[J].

[本文引用: 1]

[本文引用: 1]

[本文引用: 1]

[J].

[本文引用: 1]

[J].

[本文引用: 1]

[本文引用: 1]

[J].

DOI:10.2514/3.8290URL [本文引用: 1]

[J].

[本文引用: 1]

[J].

DOI:10.1063/1.168744URL [本文引用: 1]

[本文引用: 1]

[本文引用: 1]

[J].

[本文引用: 1]

[J].

[本文引用: 1]