Pseudo-inverse learners(PILs)是一种用伪逆学习(PIL)算法训练的前馈神经网络,最早可追溯到1995年。PIL是我们首次提出的一种非梯度下降学习方法,相比于经典的梯度下降学习算法,其主要优点在于计算代价更低,计算速度更快,不要求激活函数可微分。PIL尤其是在小规模计算,例如边缘计算研究领域的表现更为明显。然而,PIL多用于确定性学习问题。

因此,为解决目前在深度学习中网络结构难以确定,基于随机梯度下降的学习算法带来的不确定性问题,我们提出了一种称为为贝叶斯伪逆学习(BPIL)的近似协同学习(Approximated Synergetic Learning --ASL)的方案,将不确定学习转化为确定性学习。

在所提出的BPIL算法中,我们将后验概率密度函数设为:

其中

论文中提出的BPIL中,采用SLS(协同学习系统)的框架,子系统的模型使用概率模型,并且用PIL方法代替梯度下降算法。在该方法中,假设Z是隐变量,

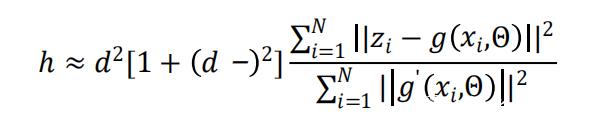

在该方法中,不确定性问题用概率模型表示,然后采用ASL方法来实现概率模型转换,使用PIL来训练BPIL,并且使用ASL方法导出的正则化超参数估计公式:

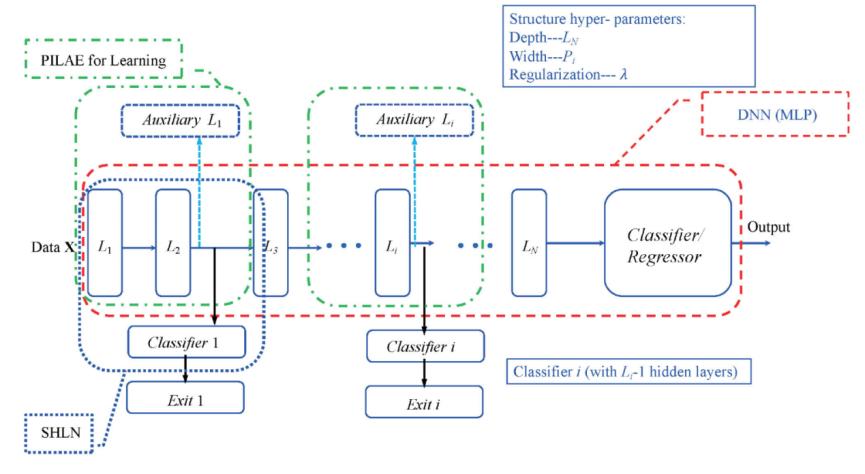

我们认为多层感知器(MLP)是堆叠的自动编码器加上一个单层分类器。在学习处理中,引入辅助层构造自编码器,在获得编码器连接权值矩阵后,将该辅助层(解码器)丢弃,编码器的输出发送到PIL分类器。采用我们提出的伪逆学习自编码算法(PILAE),不需要用户设置学习参数。更为重要的贡献是在BPIL框架下,构建深度神经网络的基础模块是非可微分构件。下图给出了搜索深度神经网络(NAS)最优体系结构的过程。利用训练数据构造自编码器,利用验证数据确定超参数,包括隐神经元数和权值衰减正则化参数。测试数据用于计算网络输出精度,从而判断该学习者是否满足给定的任务要求。如果达到任务要求,网络将停止生长并退出训练处理。否则,网络增长一层,以这种方式实现动态网络结构优化。这种深度网络结构优化的策略可用到自动机器学习中去,为破解深度学习中的网络拓扑结构设计难的困境迈出了重要的一步。

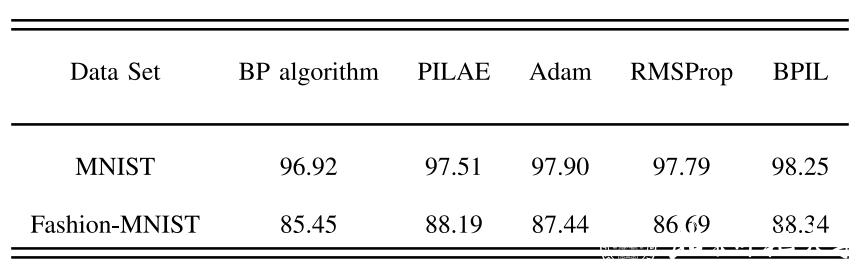

使用该算法在MNIST数据集和Fashion-MNIST数据集中与传统的算法和其他优化算法做了对比实验,分类的精确度对比如下:

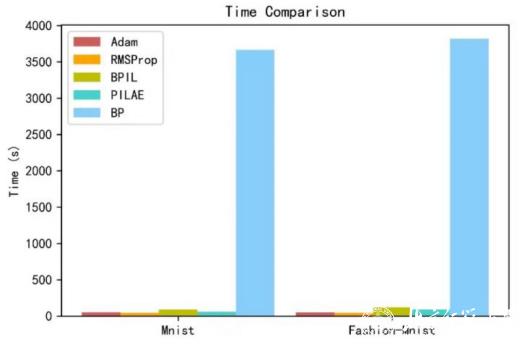

可以看到BPIL在分类中有更好的表现。时间的对比图如下:

相比于传统的BP算法,BPIL的计算代价大大减少,并且BPIL和其他优化算法相差不多,在几秒到几十秒的差距内,但却提高了精度。

上述研究成果于2021年6月在线发表在人工智能领域期刊《IEEE Transactions on Cybernetics》,题为《Bayesian Pseudoinverse Learners: From Uncertainty to Deterministic Learning》。该论文的第一作者单位与通讯作者单位均为北京师范大学,第一作者为人工智能学院的尹乾副教授,通讯作者为系统科学学院的郭平教授。该研究得到了科技创新2030—“新一代人工智能”重大项目课题的资助((No. 2018AAA0100203)。

原文链接:https://doi.org/10.1109/TCYB.2021.3079906